A diferenca entre uma demo de IA e um sistema de IA em producao resume-se a uma palavra: guardrails. Todas as equipas que puseram LLMs a funcionar em escala ja aprenderam isto — muitas vezes a custa de falhas caras e embaracosas. A inteligencia bruta do modelo nao compra fiabilidade. Uma analise a 1200 deployments de LLMs em producao confirmou o que os praticantes ja suspeitavam: as organizacoes mais bem-sucedidas investem na engenharia do sistema a volta do modelo, em vez de ficarem a espera que o modelo fique mais esperto. Entretanto, 68% das organizacoes que operam LLMs sem guardrails adequados reportaram incidentes de seguranca em 2024, e a Forrester estima que as perdas financeiras globais causadas por outputs alucinados de IA atingiram 67,4 mil milhoes de dolares nesse mesmo ano. As equipas que entregam IA fiavel tratam os guardrails como infraestrutura — nao como algo que se acrescenta depois.

Que aspeto tem essa infraestrutura? Quatro pilares de engenharia aparecem repetidamente em deployments de producao: limiares de confianca que sabem quando devolver o controlo, validacao de outputs que garante a correcao, escalamento humano que apanha o que a automacao falha, e trilhos de auditoria que tornam cada decisao rastreavel. Eis como as equipas ligam tudo isto — e o que corre mal quando saltam uma camada.

Os scores de confianca determinam o que se automatiza e o que nao

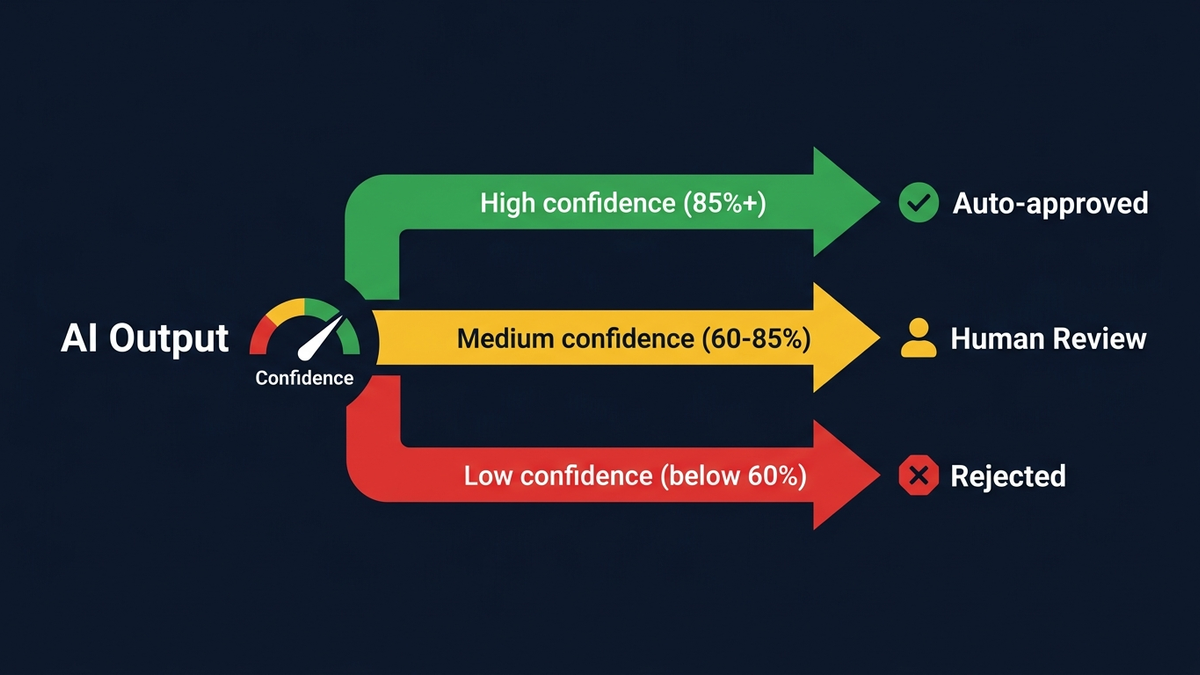

Qualquer decisao de IA em producao comeca com uma pergunta: quao certo esta o modelo? Os limiares de confianca traduzem essa certeza em acao. A arquitetura padrao usa tres niveis. Outputs acima de 0,85–0,95 de confianca sao aprovados automaticamente. Scores entre 0,60 e 0,85 vao para filas de revisao humana. Tudo abaixo de 0,60 e rejeitado ou desencadeia uma escalacao completa. Nao sao cortes arbitrarios — estes numeros sao calibrados contra tolerancias de risco especificas do dominio e ajustados continuamente.

Em sistemas baseados em LLMs, a confianca deriva tipicamente de log probabilities (logprobs), que a OpenAI expoe atraves da sua Chat Completions API. Um logprob de -0,693 traduz-se em aproximadamente 50% de probabilidade para um dado token. Os engenheiros agregam estes valores ao longo dos tokens de output usando media de probabilidade linear ou scores de perplexidade. Para tarefas de classificacao, o logprob do token da classe prevista serve diretamente como score de confianca. Em sistemas RAG, um padrao comum e o modelo gerar um booleano has_sufficient_context_for_answer — o logprob desse token torna-se o sinal de qualidade da recuperacao.

Mas os logprobs em bruto mentem. Um modelo a reportar 90% de confianca pode estar correto apenas 70% das vezes — o problema da “alucinacao confiante” que torna o encaminhamento ingenuo por limiares perigoso. Tecnicas de calibracao pos-hoc como temperature scaling, Platt scaling e regressao isotonica colmatam esta lacuna ao mapear scores em bruto para probabilidades reais. A metrica Expected Calibration Error (ECE) mede a eficacia disto: um modelo bem calibrado que afirma 80% de confianca deve acertar aproximadamente 80% das vezes.

Praticantes experientes tratam os limiares como controlos de negocio dinamicos, nao como configuracao estatica. A Rossum, uma empresa de IA documental, define o limiar de automacao por defeito em 0,975 — tolerando apenas uma taxa de erro maxima de 2,5% para faturas processadas automaticamente. Sistemas mais sofisticados variam os limiares por campo: numeros de fatura exigem precisao quase perfeita enquanto nomes de fornecedores toleram mais flexibilidade. Algumas organizacoes ajustam os limiares por contexto — agressivo (0,70) durante o horario normal de trabalho para maximizar throughput, conservador (0,90) durante o fecho mensal para maximizar precisao. Uma abordagem surpreendentemente pragmatica para uma area que adora sobre-engenheirar as coisas.

E depois ha a abstencao — ensinar modelos a dizer “nao sei.” Um estudo de 2025 na Transactions of the ACL organizou estrategias de abstencao em abordagens baseadas em prompting, metodos de fine-tuning como R-tuning e aprendizagem por reforco com regras de scoring adequadas. No entanto, o AbstentionBench, um benchmark 35 vezes maior que esforcos anteriores, revelou uma verdade preocupante: mesmo o GPT-4 e modelos de raciocinio avancado tem dificuldade em reconhecer de forma fiavel queries sem resposta possivel. Nao existe correlacao entre a precisao das respostas de um modelo e a sua capacidade de se abster — sao competencias ortogonais que precisam de ser engenheiradas separadamente. A serio: o vosso modelo mais inteligente pode tambem ser o mais imprudentemente confiante.

A validacao de outputs apanha o que o scoring de confianca falha

Os scores de confianca dizem-nos quao certo o modelo esta. A validacao de outputs diz-nos se o que ele produziu esta de facto correto. Sao problemas diferentes, e os sistemas de producao empilham multiplas estrategias de validacao para atacar ambos — desde imposicao estrutural ate verificacao semantica.

A imposicao de outputs estruturados evoluiu bastante. Os structured outputs de fornecedores como a OpenAI (lancados em agosto de 2024) alcancam 100% de conformidade com JSON schema atraves de constrained decoding — o sistema compila um JSON schema numa gramatica que restringe a geracao de tokens em tempo de inferencia. Antes disto? Mesmo o GPT-4 produzia JSON valido menos de 40% das vezes em schemas complexos. A Anthropic seguiu com a sua propria versao beta de structured outputs em novembro de 2025, oferecendo tanto modo JSON como tool use estrito com constrained decoding nos modelos Claude. Bibliotecas multi-fornecedor como Instructor e LiteLLM abstraem tudo isto por detras de interfaces unificadas baseadas em Pydantic, tornando a imposicao de schemas agnostica ao fornecedor.

Para alem da correcao estrutural, a validacao de conteudo exige uma abordagem em camadas. O padrao de producao que emergiu na industria segue um pipeline de cinco fases:

- Validacao de input deteta ataques de prompt injection, identifica PII e impoe limites tematicos.

- Validacao de recuperacao (em sistemas RAG) filtra chunks irrelevantes e mascara dados sensiveis antes de chegarem ao modelo.

- Restricoes de geracao aplicam structured outputs e controlos de temperatura.

- Validacao de output verifica toxicidade, alucinacoes e conformidade de formato.

- Monitorizacao acompanha o drift de confianca e alimenta correcoes de volta ao sistema.

Tres frameworks open-source de guardrails dominam este espaco — e cada um tem a sua personalidade propria. O NeMo Guardrails da NVIDIA usa Colang, uma linguagem de dominio especifico para definir fluxos conversacionais e rails de seguranca. Suporta rails de input, output, dialogo, recuperacao e execucao com detecao acelerada por GPU a atingir latencia sub-segundo em cinco guardrails paralelos. O Guardrails AI segue uma abordagem diferente — validadores de output composiveis atraves do seu Hub, com verificacoes pre-construidas para regex matching, validacao de comprimento, detecao de PII e scoring de toxicidade que envolvem chamadas LLM e validam outputs automaticamente. E o Llama Guard 3 da Meta fornece classificacao de seguranca multimodal em 14 categorias de dano, implantavel on-premise para ambientes sensiveis a dados. Para seguranca especifica de agentes, o LlamaFirewall da Meta (maio de 2025) usa classificadores baseados em ML para detecao de prompt injection, verificacao de alinhamento e analise de seguranca de codigo, alcancando mais de 90% de reducao nas taxas de sucesso de ataques em benchmarks de agentes.

A detecao de alucinacoes continua a ser o problema de validacao mais dificil. Os melhores modelos alcancam agora taxas de alucinacao inferiores a 1% em benchmarks de sumarizacao — o Gemini-2.0-Flash da Google lidera com 0,7% — mas as taxas de alucinacao em conhecimento geral continuam a rondar os 9,2% em media. Essa diferenca importa. O RAG reduz alucinacoes entre 40 e 71%, mas investigadores ja demonstraram matematicamente que eliminar alucinacoes por completo e impossivel com as arquiteturas LLM atuais. Por isso, os sistemas de producao empilham multiplos metodos de detecao: pipelines de Chain-of-Verification que geram e respondem independentemente a perguntas de verificacao (reduzindo alucinacoes em ate 53%), entropia semantica que agrupa respostas com diferentes formulacoes para medir incerteza ao nivel do significado, e sondagem de atencao entre camadas que sinaliza alucinacoes em tempo real usando classificadores leves sobre as ativacoes do modelo.

Quando a IA deve passar a bola ao humano — e como tornar essa passagem limpa

O ponto ideal para escalamento humano em producao situa-se em 10 a 15% do total de decisoes. Abaixo disso, provavelmente estao a carimbar tarefas que mereciam olhos humanos. Acima de 20%, tem um estrangulamento. Acima de 60%, o sistema precisa de uma recalibracao fundamental.

Os gatilhos de escalamento dividem-se em tres categorias. Os gatilhos baseados em confianca encaminham outputs com scores baixos para filas de revisao — direto ao assunto. Os gatilhos baseados em regras escalam sempre condicoes especificas: montantes financeiros acima de um limiar, acoes que afetam multiplos utilizadores, tipos de tarefa ineditos ou outputs que contradizem decisoes anteriores para o mesmo utilizador. Os gatilhos de matriz de risco sao os mais sofisticados, avaliando quatro dimensoes simultaneamente: irreversibilidade da acao, raio de impacto de um potencial erro, exposicao regulatoria e confianca do modelo. A combinacao determina se e necessaria revisao humana. Nenhum fator isolado.

Mas a arquitetura da passagem de testemunho importa tanto como o que a desencadeia. Tres padroes dominam em producao:

- Aprovacao pre-acao pausa a execucao antes de acoes irreversiveis e apresenta a acao proposta com o raciocinio para decisao humana.

- Auditoria pos-acao deixa a IA atuar de imediato em decisoes reversiveis enquanto humanos fazem amostragem e revisao a posteriori.

- Encaminhamento baseado em confianca automatiza a decisao entre estes dois modos.

A funcao interrupt() do LangGraph tornou-se uma escolha de implementacao popular — pausa a execucao do grafo a meio do workflow, aguarda input humano e retoma de forma limpa. Para workflows assincronos, ferramentas como o HumanLayer encaminham decisoes para canais Slack, email ou dashboards para revisao nao-bloqueante.

O verdadeiro retorno vem do ciclo de feedback. Quando os revisores consistentemente desvalorizam outputs pela mesma razao, isso desencadeia revisao de prompts ou alteracoes de pre-processamento. Quando uma classe de tarefas requer sempre intervencao, e sinal de que a tarefa ainda nao deve ser automatizada. A AWS demonstrou uma reducao de 80% na carga de trabalho dos especialistas ao combinar RLHF com RLAIF — a IA gera avaliacoes iniciais, os humanos verificam em vez de criarem de raiz. O Cursor processa 400 milhoes de pedidos diarios para a sua funcionalidade Tab e executa um pipeline de RL online que atualiza com base nas taxas de aceitacao dos utilizadores em poucas horas, produzindo um aumento de 28% na aceitacao de codigo.

Padroes especificos de dominio que funcionam na pratica

Implementacoes reais de HITL revelam padroes especificos de dominio bem marcados. Em servicos financeiros, o agente de politicas da Ramp gere mais de 65% das aprovacoes de despesas de forma autonoma, mas cada nova capacidade passa primeiro por testes em shadow mode — o agente preve acoes enquanto um LLM juiz compara previsoes com decisoes humanas reais, so entrando em producao apos atingir limiares de precisao. Zero dinheiro real em risco durante o treino. Essa disciplina e rara.

Na saude, leitores de radiologia assistidos por IA melhoraram a sua precisao diagnostica de scores kappa de 0,6 para 0,9, igualando radiologistas especialistas. Mas ha uma descoberta incomoda: endoscopistas que usaram IA durante tres meses viram as taxas de detecao diminuir apos a IA ser desligada. O risco de perda de competencias e real, e ninguem tem ainda uma boa resposta para isto.

Em tecnologia juridica, a IA revisa contratos 80% mais rapido do que humanos com 94% de precisao. Parece otimo — ate se descobrir que apenas 68% das respostas do GPT-4 relacionadas com contratos foram consideradas “praticamente viaveis” por especialistas juridicos. A supervisao humana e inegociavel para trabalho juridico com consequencias reais.

Os trilhos de auditoria nao sao opcionais — sao legalmente obrigatorios

Se acham que o registo de auditoria e um nice-to-have, a UE discorda. O Artigo 12 do AI Act da UE exige que sistemas de IA de alto risco permitam tecnicamente o registo automatico de eventos ao longo de toda a vida util do sistema, com logs inviolaveis retidos por um minimo de seis meses. O Artigo 26 obriga os utilizadores do sistema a atribuir supervisao humana a pessoas competentes e a monitorizar o funcionamento do sistema. As penalizacoes chegam a 35 milhoes de euros ou 7% do volume de negocios global. E estes nao sao requisitos futuros — as regras de governacao e obrigacoes para IA de uso geral entraram em vigor em agosto de 2025, com as regras para sistemas de alto risco a entrar em pleno efeito ate agosto de 2026.

O RGPD acrescenta mais uma camada. O Artigo 22 da aos titulares dos dados o direito de nao ficarem sujeitos a decisoes baseadas exclusivamente em tratamento automatizado que produza efeitos juridicos ou igualmente significativos. Qualquer sistema de IA que tome decisoes consequentes sobre individuos — aprovacao de emprestimos, contratacao, precos de seguros — tem de fornecer mecanismos de intervencao humana, explicacoes da logica envolvida e a possibilidade de os individuos contestarem decisoes. Sem trilho de auditoria, sem conformidade. Sem conformidade, sem deployment.

A boa noticia: as ferramentas de observabilidade ja acompanham. As GenAI Semantic Conventions do OpenTelemetry (v1.37+) tornaram-se o padrao da industria para telemetria de LLMs, definindo atributos comuns como gen_ai.request.model, gen_ai.usage.input_tokens e gen_ai.provider.name entre fornecedores. O LLM Observability da Datadog suporta nativamente as convencoes OTel GenAI, correlacionando spans de LLM com traces APM tradicionais. O Phoenix open-source da Arize AI usa a especificacao OpenInference construida sobre OpenTelemetry. O LangSmith captura arvores de execucao completas — selecoes de ferramentas, documentos recuperados, parametros exatos em cada passo — com filas de anotacao que permitem a especialistas de dominio rever e classificar traces.

O que e que as equipas de producao registam realmente por chamada de inferencia? Mais do que se poderia esperar:

- Conteudo completo de input/output (ou hashes criptograficos para dados sensiveis)

- Nome e versao do modelo

- ID e versao do prompt template

- Contagens de tokens discriminadas por input, output, cache e tokens de raciocinio

- Custo calculado e metricas de latencia (duracao total, tempo ate ao primeiro token, tempo de processamento LLM)

- Temperatura e parametros de sampling

- Finish reason

- IDs de trace e span para tracing distribuido

- Metadados de negocio como ID de utilizador, ambiente, grupo de teste A/B e feature flags

O versionamento de prompts tornou-se uma disciplina de engenharia de primeira classe. A boa pratica segue semantic versioning (major.minor.patch), com versoes imutaveis — uma vez criada, uma versao de prompt nunca e modificada. Alteracoes criam novas versoes implementadas atraves de promocao por ambientes (dev → staging → production), com cada trace de producao ligado a versao exata do prompt usado. Ferramentas como LangSmith, Langfuse, Braintrust e Helicone suportam isto nativamente. A ISO 42001, a primeira norma certificavel de gestao de sistemas de IA do mundo, foi adotada pela Microsoft, Google Cloud e AWS — estabelecendo expectativas de governacao de base para IA empresarial.

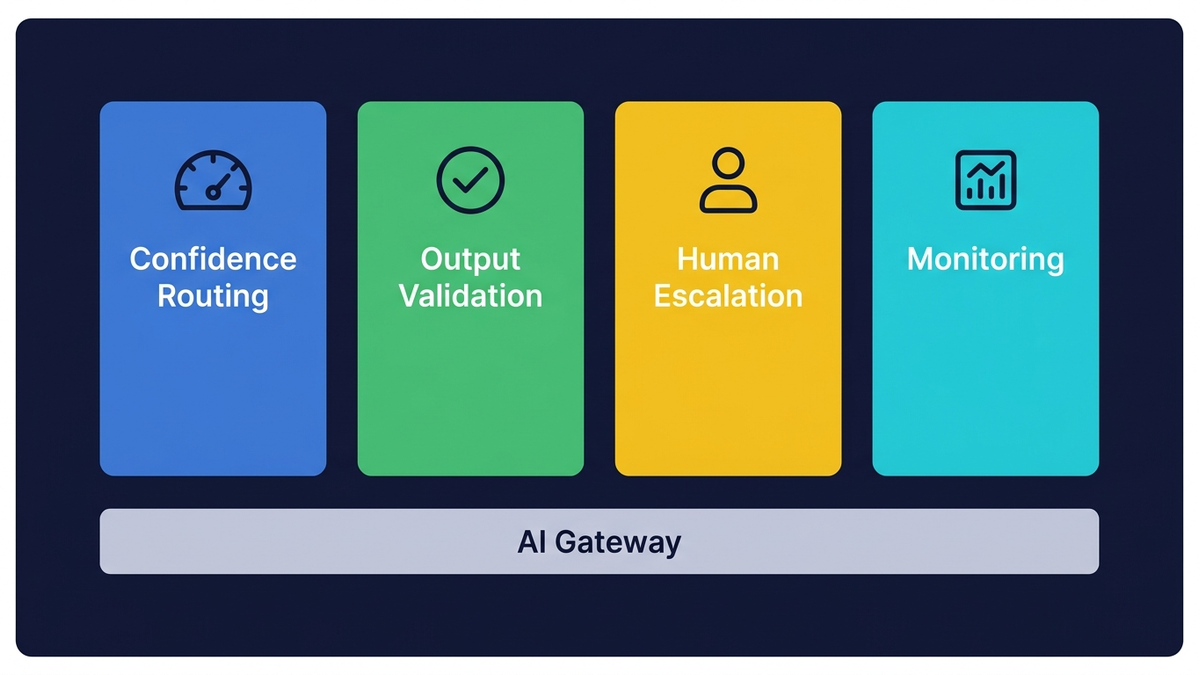

Como os quatro pilares se ligam numa camada de fiabilidade unificada

Nenhum destes pilares funciona isoladamente. A arquitetura de referencia que esta a emergir em deployments de producao empilha-os num sistema em camadas:

- A camada de aplicacao gere feature flags, canary routing e testes A/B para alteracoes de prompts.

- A camada de gateway de IA — implementada atraves de ferramentas como Portkey (a processar mais de 10 mil milhoes de pedidos mensais), LiteLLM ou TensorZero — gere encaminhamento multi-fornecedor, rate limiting, caching, circuit breakers e observabilidade.

- A camada de guardrails impoe validacao de inputs e outputs atraves do NeMo Guardrails, Guardrails AI, Llama Guard ou opcoes cloud-native como AWS Bedrock Guardrails.

- A camada de avaliacao executa verificacoes CI/CD atraves do DeepEval e Promptfoo, scans de red-team antes do deployment e monitorizacao continua em producao.

Os circuit breakers adaptados para IA acrescentam um padrao de resiliencia critico. Ao contrario dos circuit breakers tradicionais que disparam com erros HTTP, os circuit breakers de IA precisam tambem de rastrear falhas de qualidade— se um LLM devolver JSON malformado ou dados alucinados tres vezes consecutivas, o circuito dispara mesmo que as chamadas API tenham tecnicamente “sucedido.” A Cox Automotive implementa limites rigidos: conversas que excedam 20 turnos ou custos que atinjam limiares P95 desencadeiam handoff automatico e gracioso para agentes humanos.

A falha multi-fornecedor de dezembro de 2024 provou porque e que isto importa. A OpenAI ficou em baixo durante quatro horas enquanto o Claude e o Gemini degradaram simultaneamente. As equipas que sobreviveram tinham cadeias de degradacao graciosa — uma hierarquia de cinco niveis: modelo principal para modelo mais barato/rapido para respostas em cache para heuristicas baseadas em regras para escalamento humano. O sistema de scheduling de uma companhia aerea sobreviveu a uma falha cloud ao mudar para um otimizador heuristico (valido em 90% dos casos), depois um motor de regras para restricoes simples, sinalizando os restantes 5% para revisao manual — zero voos cancelados. Este e o tipo de engenharia de resiliencia que separa sistemas de producao de projetos de ciencia.

Alteracoes de prompts merecem a mesma cautela de deployment que alteracoes de codigo — talvez ate mais, porque os seus efeitos sao mais dificeis de prever. Novas versoes de prompts recebem 1 a 5% do trafego de producao enquanto metricas de qualidade — nao apenas taxas de erro — sao monitorizadas. Alteracoes de prompts podem ter impactos subtis na qualidade invisiveis nas metricas de saude do sistema, exigindo janelas de observacao mais longas para significancia estatistica. So apos confirmacao de qualidade e que o trafego sobe gradualmente ate aos 100%.

Licoes das equipas que estao a acertar

A licao mais clara da producao: o estrangulamento e a engenharia, nao a inteligencia. As equipas que entregam sistemas LLM fiaveis parecem-se com equipas que entregam qualquer outra infraestrutura critica — disciplinadas quanto a modos de falha, rigorosas na avaliacao, pragmaticas sobre quais os componentes que precisam de ser a prova de bala. A Ramp testa em shadow cada nova capacidade de IA contra transacoes financeiras reais sem arriscar um centimo. A Stripe construiu um modelo foundation especifico de dominio que melhorou a detecao de fraude em testes de cartao de 59% para 97% de precisao, recuperando 6 mil milhoes de dolares em pagamentos legitimos. A Shopify serve 30 milhoes de previsoes diarias em mais de 10 000 categorias de produtos com uma taxa de aceitacao de 85% por parte dos comerciantes.

E no entanto — a Gartner preve que 40% dos projetos de IA agentica serao cancelados ate 2027 devido a custos crescentes, valor de negocio pouco claro ou controlos de risco inadequados. Quarenta por cento. Os sobreviventes serao as equipas que trataram os guardrails como infraestrutura central desde o primeiro dia — movendo a logica de seguranca dos prompts para o codigo, onde restricoes arquiteturais fornecem garantias que o prompt engineering nunca conseguira.

Os guardrails nao vos atrasam — tornam seguro andar depressa

A fiabilidade de IA em producao esta a convergir para um padrao arquitetural claro: encaminhamento consciente da confianca, validacao em camadas, escalamento humano estruturado e observabilidade abrangente — tudo orquestrado atraves de gateways de IA que servem como plano de controlo central. A mudanca definidora de 2024–2025 foi o movimento sistematico da logica de seguranca dos prompts para a infraestrutura.

Organizacoes com frameworks de governacao maduros alcancam tempos de chegada a producao 3 vezes mais rapidospara novas funcionalidades de IA, nao apesar dos guardrails mas por causa deles. So essa descoberta devia acabar com todos os argumentos de “os guardrails atrasam-nos” em todas as reunioes de planeamento, para sempre. A engenharia e o produto. Os guardrails sao a funcionalidade.