L'écart entre une démo d'IA et un système d'IA en production tient en un seul mot : garde-fous. Les organisations qui déploient des LLM à grande échelle l'ont appris — souvent au prix de pannes coûteuses et humiliantes — que l'intelligence brute d'un modèle ne garantit aucune fiabilité. Une analyse de 1 200 déploiements LLM en production a montré que les équipes les plus performantes conçoivent le système autourdu modèle plutôt que d'attendre qu'il devienne plus intelligent. Pendant ce temps, 68 % des organisations déployant des LLM sans garde-fous suffisants ont signalé des incidents de sécurité en 2024, et Forrester estime que les pertes financières mondiales liées aux sorties hallucinées de l'IA ont atteint 67,4 milliards de dollarsla même année. Les équipes qui livrent des systèmes d'IA fiables traitent les garde-fous comme une infrastructure à part entière, pas comme un ajout de dernière minute.

Quatre piliers d'ingénierie fondent la base d'une IA de production digne de confiance : des seuils de confiance qui savent quand s'effacer, une validation des sorties qui impose la justesse, une escalade humaine qui rattrape ce que l'automatisation laisse passer, et des pistes d'audit qui rendent chaque décision traçable. Voici comment les meilleures équipes d'ingénierie assemblent ces briques en systèmes qui fonctionnent réellement.

Les scores de confiance déterminent ce qui s'automatise — et ce qui ne s'automatise pas

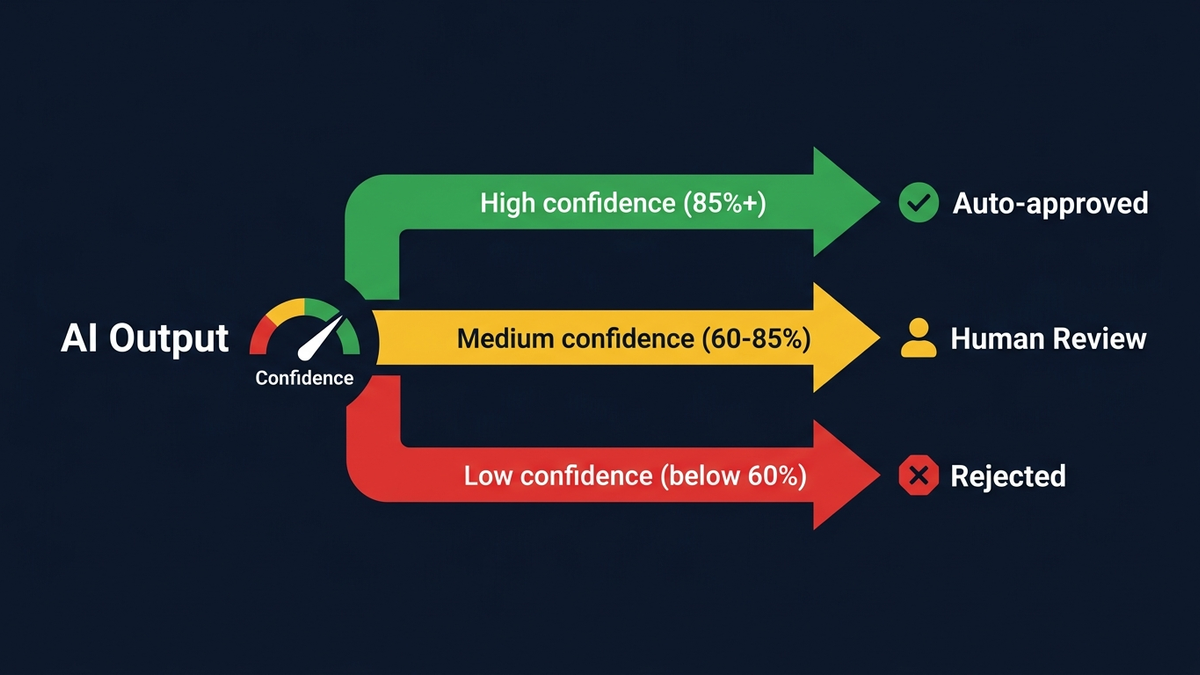

Chaque décision d'IA en production commence par une question : à quel point le modèle est-il sûr de lui ? Les seuils de confiance traduisent cette certitude en action. L'architecture standard repose sur trois paliers. Les sorties au-dessus de 0,85–0,95 de confiance sont validées automatiquement. Les scores entre 0,60 et 0,85 sont orientés vers des files de révision humaine. Tout ce qui tombe sous 0,60 est rejeté ou déclenche une escalade complète. Ce ne sont pas des chiffres arbitraires — ils sont calibrés en fonction des tolérances au risque propres à chaque domaine, puis ajustés en continu.

Pour les systèmes fondés sur des LLM, la confiance se déduit généralement des log probabilités (logprobs), qu'OpenAI expose via son API Chat Completions. Un logprob de -0,693 correspond à environ 50 % de probabilité pour un token donné. Les ingénieurs les agrègent sur l'ensemble des tokens de sortie à l'aide de méthodes comme le calcul de probabilité linéaire moyenne ou les scores de perplexité. Pour les tâches de classification, le logprob du token de classe prédit sert directement de score de confiance. Dans les systèmes RAG, un schéma courant consiste à faire générer par le modèle un booléen has_sufficient_context_for_answer — le logprob associé à ce token devient le signal de qualité de la récupération.

Mais les logprobs bruts sont trompeurs sans calibration. Un modèle affichant 90 % de confiance peut en réalité n'être correct que 70 % du temps — c'est le problème de l'“hallucination confiante” qui rend le routage naïf par seuil dangereux. Les techniques de calibration a posteriori comme le temperature scaling, le Platt scaling et la régression isotonique comblent cet écart en transformant les scores bruts en probabilités réelles. La métrique Expected Calibration Error (ECE) mesure la qualité de la calibration : un modèle bien calibré annonçant 80 % de confiance doit avoir raison environ 80 % du temps.

Les praticiens aguerris traitent les seuils comme des leviers métier dynamiques, pas comme des paramètres statiques figés dans un fichier de configuration. Rossum, une entreprise spécialisée dans l'IA documentaire, fixe son seuil d'automatisation par défaut à 0,975— n'acceptant qu'un taux d'erreur maximal de 2,5 % pour les factures traitées automatiquement. Les systèmes plus affinés font varier les seuils par champ : les numéros de facture exigent une précision quasi parfaite, tandis que les noms de fournisseurs tolèrent davantage de souplesse. Certaines organisations adaptent même les seuils au contexte — agressifs (0,70) pendant les heures ouvrées normales pour maximiser le débit, conservateurs (0,90) pendant la clôture mensuelle pour la précision. Une approche étonnamment pragmatique pour un domaine qui adore sur-ingénierer.

La discipline émergente de l'abstention — apprendre aux modèles à dire “je ne sais pas” — ajoute une dimension critique. Une étude de 2025 dans les Transactions of the ACLa catalogué les stratégies d'abstention à travers des approches par prompting, des méthodes de fine-tuning comme le R-tuning et l'apprentissage par renforcement avec des règles de scoring appropriées. Pourtant, AbstentionBench, un benchmark 35 fois plus vaste que les efforts précédents, a révélé une vérité glaçante : même GPT-4 et les modèles de raisonnement avancés peinent à reconnaître de manière fiable les requêtes sans réponse. Aucune corrélation n'existe entre la précision des réponses d'un modèle et sa capacité à s'abstenir — ce sont des capacités orthogonales qui doivent être conçues séparément. Autrement dit : votre modèle le plus brillant est peut-être aussi le plus témérairement sûr de lui.

La validation des sorties rattrape ce que le scoring de confiance laisse filer

Les scores de confiance vous indiquent à quel point le modèle est sûr de lui. La validation des sorties vous dit si ce qu'il a produit est réellement correct. Les systèmes de production empilent plusieurs stratégies de validation, de l'application de contraintes structurelles à la vérification sémantique.

L'application de formats structurés a considérablement mûri. Les sorties structurées des fournisseurs comme OpenAI (lancées en août 2024) atteignent une conformité de 100 % au schéma JSONgrâce au décodage contraint — le système compile un schéma JSON en grammaire qui restreint la génération de tokens à l'inférence. Avant cela, même GPT-4 produisait du JSON valide moins de 40 % du temps sur des schémas complexes. Anthropic a suivi avec sa propre bêta de sorties structurées en novembre 2025, proposant un mode JSON et un usage strict des outils avec décodage contraint sur les modèles Claude. Les bibliothèques multi-fournisseurs comme Instructor et LiteLLM abstraient désormais ces capacités derrière des interfaces unifiées basées sur Pydantic, rendant l'application de schémas agnostique vis-à-vis du fournisseur.

Au-delà de la conformité structurelle, la validation du contenu exige une approche par couches. Le patron de production qui s'est imposé dans l'industrie suit un pipeline en cinq étapes :

- Validation des entrées : détection des attaques par prompt injection, identification des données personnelles (PII) et application des limites thématiques.

- Validation de la récupération(dans les systèmes RAG) : filtrage des fragments non pertinents et masquage des données sensibles avant qu'ils n'atteignent le modèle.

- Contraintes de génération : application des sorties structurées et des contrôles de température.

- Validation des sorties : vérification de la toxicité, des hallucinations et de la conformité au format attendu.

- Monitoring : suivi de la dérive de confiance et injection des corrections dans la boucle.

Trois frameworks open source de garde-fous dominent cet espace. NeMo Guardrails de NVIDIA utilise Colang, un langage spécifique pour définir des flux conversationnels et des rails de sécurité, prenant en charge les rails d'entrée, de sortie, de dialogue, de récupération et d'exécution, avec une détection accélérée par GPU atteignant une latence inférieure à la seconde sur cinq garde-fous parallèles. Guardrails AI mise sur des validateurs de sortie composables via son Hub — des vérifications prêtes à l'emploi pour le matching regex, la validation de longueur, la détection de PII et le scoring de toxicité, qui encapsulent les appels LLM et valident automatiquement les sorties. Llama Guard 3 de Meta fournit une classification de sécurité multimodale couvrant 14 catégories de préjudices, déployable sur site pour les environnements sensibles en matière de données. Pour la sécurité spécifique aux agents, le LlamaFirewall de Meta (mai 2025) s'appuie sur des classifieurs par apprentissage automatique pour la détection d'injections de prompt, la vérification d'alignement et l'analyse de sécurité du code, atteignant une réduction de plus de 90 % du taux de réussite des attaquessur les benchmarks d'agents.

La détection des hallucinations reste le défi de validation le plus redoutable. Les meilleurs modèles atteignent désormais des taux d'hallucination inférieurs à 1 % sur les benchmarks de résumé — le Gemini-2.0-Flash de Google mène à 0,7 %— mais les taux d'hallucination sur les connaissances générales tournent en moyenne autour de 9,2 %. Le RAG réduit les hallucinations de 40 à 71 %, mais des chercheurs ont démontré mathématiquement qu'éliminer totalement les hallucinations est impossible avec les architectures LLM actuelles. Les systèmes de production combinent plusieurs méthodes de détection : les pipelines Chain-of-Verification qui génèrent et répondent indépendamment à des questions de vérification (réduisant les hallucinations jusqu'à 53 %), l'entropie sémantique qui regroupe des réponses formulées différemment pour mesurer l'incertitude au niveau du sens, et le sondage d'attention inter-couches qui signale les hallucinations en temps réel grâce à des classifieurs légers sur les activations du modèle.

Quand l'IA doit passer la main à l'humain — et comment réussir la transition

Le taux d'escalade humaine optimal pour les systèmes en production se situe entre 10 et 15 % du total des décisions. En dessous, vous automatisez probablement des tâches qui ne devraient pas l'être. Au-dessus de 20 %, vous avez un goulet d'étranglement. Au-delà de 60 %, votre système a besoin d'un recalibrage fondamental.

Les déclencheurs d'escalade se répartissent en trois catégories. Les déclencheurs fondés sur la confiance orientent les sorties à faible score vers des files de révision. Les déclencheurs basés sur des règles escaladent systématiquement certaines conditions — montants financiers dépassant un seuil, actions affectant plusieurs utilisateurs, types de tâches rencontrés pour la première fois, ou sorties contredisant des décisions antérieures pour le même utilisateur. Les déclencheurs par matrice de risque évaluent simultanément quatre dimensions : l'irréversibilité de l'action, le rayon d'impact d'une erreur potentielle, l'exposition réglementaire et la confiance du modèle. C'est la combinaison qui détermine si une revue humaine est nécessaire, pas un facteur isolé.

L'architecture du passage de relais compte autant que la logique de déclenchement. Trois schémas dominent en production :

- L'approbation préalablesuspend l'exécution avant toute action irréversible et présente l'action proposée avec son raisonnement pour décision humaine.

- L'audit post-actionlaisse l'IA agir immédiatement sur les décisions réversibles, pendant que des humains échantillonnent et révisent a posteriori.

- Le routage par confiance automatise le choix entre ces deux modes.

La fonction interrupt()de LangGraph est devenue un choix d'implémentation populaire : elle suspend l'exécution du graphe en cours de workflow, attend l'intervention humaine, puis reprend proprement. Pour les workflows asynchrones, des outils comme HumanLayer orientent les décisions vers des canaux Slack, des e-mails ou des tableaux de bord pour une revue non bloquante.

La boucle de rétroaction des corrections humaines vers l'amélioration du modèle : c'est là que les systèmes HITL créent une valeur composée. Quand les réviseurs dégradent systématiquement les sorties pour la même raison, cela déclenche une révision du prompt ou des modifications de prétraitement. Quand une catégorie de tâches requiert toujours une intervention, c'est le signal que cette tâche ne devrait pas encore être automatisée. AWS a démontré une réduction de 80 % de la charge de travail des experts métier en combinant RLHF et RLAIF — l'IA génère les évaluations initiales, les humains vérifient au lieu de créer ex nihilo. Cursor traite 400 millions de requêtes par jourpour sa fonctionnalité Tab et exploite un pipeline RL en ligne qui s'ajuste en fonction des taux d'acceptation des utilisateurs en quelques heures, produisant une augmentation de 28 % de l'acceptation du code.

Des schémas sectoriels qui fonctionnent sur le terrain

Les déploiements HITL en conditions réelles révèlent des schémas sectoriels fascinants. Dans les services financiers, l'agent de politique de Ramp gère plus de 65 % des approbations de dépenses de manière autonome, mais chaque nouvelle capacité passe d'abord par un test en mode shadow — l'agent prédit des actions pendant qu'un juge LLM compare les prédictions aux décisions humaines réelles, et ne passe en production qu'après avoir atteint les seuils de précision requis.

En santé, les lecteurs de radiologie assistés par IA ont amélioré leur précision diagnostique, passant d'un score kappa de 0,6 à 0,9, au niveau de radiologues spécialisés. Mais voici le résultat qui dérange : les endoscopistes utilisant l'IA pendant trois mois ont vu leurs taux de détection chuteraprès la désactivation de l'IA. Le risque de déqualification est bien réel, et personne n'a encore trouvé de réponse satisfaisante.

En legaltech, l'IA analyse les contrats 80 % plus vite que les humains avec 94 % de précision. Impressionnant, jusqu'à ce que vous appreniez que seulement 68 % des réponses contractuelles de GPT-4 ont été jugées “exploitables en pratique” par des experts juridiques — rendant la supervision humaine incontournable pour tout travail juridique à enjeux.

Les pistes d'audit ne sont pas optionnelles — elles sont une obligation légale

L'article 12 du Règlement européen sur l'IA impose aux systèmes d'IA à haut risque de permettre techniquement l'enregistrement automatique des événements sur toute la durée de vie du système, avec des journaux infalsifiables conservés au minimum six mois. L'article 26 oblige les déployeurs à confier la supervision humaine à des personnes compétentes et à surveiller le fonctionnement du système. Les sanctions atteignent 35 millions d'euros ou 7 % du chiffre d'affaires mondial. Ce ne sont pas des exigences futuristes — les règles de gouvernance et les obligations relatives à l'IA à usage général sont applicables depuis août 2025, et les règles sur les systèmes à haut risque entreront pleinement en vigueur en août 2026.

L'article 22 du RGPD ajoute une couche supplémentaire : les personnes concernées ont le droit de ne pas faire l'objet de décisions fondées exclusivement sur un traitement automatisé produisant des effets juridiques ou des effets significatifs similaires. Tout système d'IA prenant des décisions conséquentes concernant des individus — approbation de prêts, recrutement, tarification d'assurance — doit fournir des mécanismes d'intervention humaine, des explications sur la logique utilisée et la possibilité pour les personnes de contester les décisions.

L'écosystème d'outils d'observabilité a mûri pour répondre à ces exigences. Les conventions sémantiques GenAI d'OpenTelemetry (v1.37+) se sont imposées comme le standard industriel pour la télémétrie LLM, définissant des attributs communs tels que gen_ai.request.model, gen_ai.usage.input_tokens et gen_ai.provider.name à travers les fournisseurs. La solution LLM Observability de Datadog prend nativement en charge les conventions OTel GenAI, corrélant les spans LLM avec les traces APM traditionnelles. Phoenix d'Arize AI, en open source, utilise la spécification OpenInference bâtie sur OpenTelemetry. LangSmith capture les arbres d'exécution complets — sélections d'outils, documents récupérés, paramètres exacts à chaque étape — avec des files d'annotation qui permettent aux experts métier de revoir et d'étiqueter les traces.

Les équipes de production journalisent typiquement un ensemble complet de métadonnées par appel d'inférence :

- Contenu complet des entrées/sorties (ou hachages cryptographiques pour les données sensibles)

- Nom et version du modèle

- Identifiant et version du template de prompt

- Compteurs de tokens ventilés en entrée, sortie, cache et tokens de raisonnement

- Coût calculé et métriques de latence (durée totale, temps jusqu'au premier token, temps de traitement LLM)

- Température et paramètres d'échantillonnage

- Raison de fin de génération

- Identifiants de trace et de span pour le traçage distribué

- Métadonnées métier : identifiant utilisateur, environnement, groupe de test A/B, feature flags

Le versionnement des prompts est devenu une discipline d'ingénierie à part entière. La bonne pratique suit le versionnement sémantique (major.minor.patch), avec des versions immuables — une fois créée, une version de prompt n'est jamais modifiée. Les changements créent de nouvelles versions déployées via une promotion par environnement (dev → staging → production), chaque trace de production étant liée à la version exacte du prompt utilisé. Des outils comme LangSmith, Langfuse, Braintrust et Helicone prennent en charge ce schéma nativement. La norme ISO 42001, premier référentiel certifiable de management de l'IA au monde, a été adoptée par Microsoft, Google Cloud et AWS, établissant les attentes de gouvernance de base pour l'IA en entreprise.

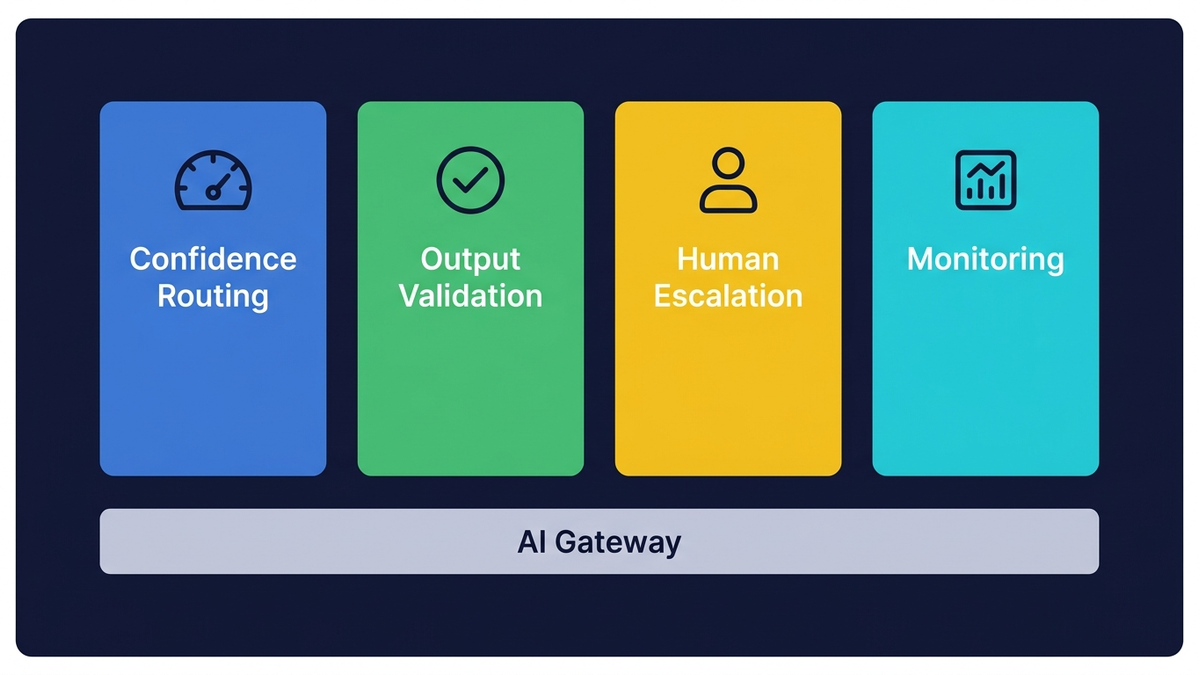

Comment les quatre piliers s'assemblent en une couche de fiabilité unifiée

Ces composants ne fonctionnent pas en silos. L'architecture de référence qui émerge des déploiements en production les empile en un système stratifié :

- La couche applicative gère les feature flags, le routage canary et les tests A/B pour les modifications de prompts.

- La couche passerelle IA — implémentée via des outils comme Portkey (traitant plus de 10 milliards de requêtes par mois), LiteLLM ou TensorZero — gère le routage multi-fournisseurs, la limitation de débit, la mise en cache, les circuit breakers et l'observabilité.

- La couche garde-fous impose la validation des entrées et des sorties via NeMo Guardrails, Guardrails AI, Llama Guard ou des solutions cloud natives comme AWS Bedrock Guardrails.

- La couche d'évaluation exécute des vérifications CI/CD via DeepEval et Promptfoo, des scans red team en pré-déploiement et un monitoring continu en production.

Les circuit breakers adaptés aux systèmes d'IA ajoutent un mécanisme de résilience déterminant. Contrairement aux circuit breakers traditionnels qui se déclenchent sur des erreurs HTTP, les circuit breakers IA doivent aussi suivre les défaillances de qualité— si un LLM renvoie du JSON malformé ou des données hallucinées trois fois de suite, le circuit s'ouvre même si les appels API ont techniquement “réussi.” Cox Automotive impose des limites strictes : les conversations dépassant 20 échanges ou les coûts atteignant les seuils P95 déclenchent un transfert gracieux automatique vers des agents humains.

La panne multi-fournisseurs de décembre 2024, quand OpenAI est tombé pendant quatre heures tandis que Claude et Gemini se dégradaient simultanément, a validé la nécessité de chaînes de dégradation gracieuse. La hiérarchie standard traverse cinq niveaux : modèle principal vers modèle plus léger et rapide vers réponses en cache vers heuristiques à base de règles vers escalade humaine. Le système de planification d'une compagnie aérienne a survécu à une panne cloud en basculant vers un optimiseur heuristique (valide dans 90 % des cas), puis un moteur de règles pour les contraintes simples, signalant les 5 % restants pour révision manuelle — zéro vol annulé. Voilà le type d'ingénierie de résilience qui sépare les systèmes de production des projets de laboratoire.

Les déploiements canary pour les modifications de prompts suivent la même logique que les canaries de code, mais ajoutent un monitoring spécifique à l'IA. Les nouvelles versions de prompts reçoivent 1 à 5 % du trafic de production pendant que les métriques de qualité — pas seulement les taux d'erreur — sont suivies. Les modifications de prompts peuvent avoir des impacts subtils sur la qualité, invisibles dans les métriques de santé système, nécessitant des fenêtres d'observation plus longues pour atteindre la significativité statistique. Ce n'est qu'après confirmation de la qualité que le trafic augmente progressivement jusqu'à 100 %.

Les leçons des équipes qui s'en sortent

L'enseignement le plus clair de la production est que le goulot d'étranglement est l'ingénierie, pas l'intelligence. Les équipes qui livrent des systèmes LLM fiables ressemblent aux équipes qui livrent n'importe quelle autre infrastructure critique : disciplinées face aux modes de défaillance, rigoureuses dans l'évaluation, pragmatiques sur les composants qui doivent être blindés. Ramp teste en shadow chaque nouvelle capacité IA contre de vraies transactions financières sans risquer un centime. Stripe a construit un modèle de fondation spécialisé qui a fait passer la détection de fraude par test de carte de 59 % à 97 % de précision tout en récupérant 6 milliards de dollars de paiements légitimes. Shopify sert 30 millions de prédictions par jourà travers plus de 10 000 catégories de produits avec un taux d'acceptation marchand de 85 %.

Gartner prédit que 40 % des projets d'IA agentique seront abandonnés d'ici 2027 en raison de coûts croissants, d'une valeur métier floue ou de dispositifs de gestion des risques inadéquats. Les survivants seront les équipes qui auront traité les garde-fous comme une infrastructure fondamentale dès le premier jour — déplaçant la logique de sécurité hors des prompts et dans le code, là où les contraintes architecturales offrent des garanties que le prompt engineering ne pourra jamais fournir.

Les garde-fous ne vous ralentissent pas — ils vous permettent d'aller vite en toute sécurité

La fiabilité de l'IA en production converge vers un schéma architectural clair : routage sensible à la confiance, validation multicouche, escalade humaine structurée et observabilité exhaustive — le tout orchestré à travers des passerelles IA qui servent de plan de contrôle central. Le virage le plus marquant de 2024–2025 a été le transfert systématique de la logique de sécurité des prompts vers l'infrastructure.

Les organisations dotées de cadres de gouvernance matures atteignent un délai de mise en production 3 fois plus courtpour les nouvelles fonctionnalités IA — non pas malgré les garde-fous, mais grâce à eux. Ce constat à lui seul devrait clore définitivement chaque argument “les garde-fous nous ralentissent” dans chaque réunion de planification. L'ingénierie est le produit. Les garde-fous sont la fonctionnalité.