Entre una demo de IA y un sistema de IA en produccion hay una sola palabra: guardrails. Las organizaciones que despliegan LLMs a escala lo han aprendido — casi siempre a golpe de fallos caros y bochornosos — que la inteligencia bruta de un modelo no produce fiabilidad. Un analisis de 1.200 despliegues de LLMs en produccion revelo que las organizaciones mas exitosas construyen ingenieria alrededor del modelo en lugar de esperar a que el modelo se vuelva mas listo. Mientras tanto, el 68% de las organizaciones que desplegaron LLMs sin guardrails adecuados reportaron incidentes de seguridad en 2024, y Forrester estima que las perdidas financieras globales por respuestas alucinadas de IA alcanzaron los 67.400 millones de dolares ese mismo ano. Los equipos que entregan sistemas de IA fiables tratan los guardrails como infraestructura, no como algo que ya se anadira despues.

Cuatro pilares de ingenieria sostienen la base de una IA de produccion confiable: umbrales de confianza que saben cuando abstenerse, validacion de salidas que impone correccion, escalamiento humano que atrapa lo que la automatizacion pasa por alto, y trazas de auditoria que hacen rastreable cada decision. Asi es como los equipos de ingenieria mas avanzados ensamblan estas piezas en sistemas que realmente funcionan.

Los scores de confianza determinan que se automatiza y que no

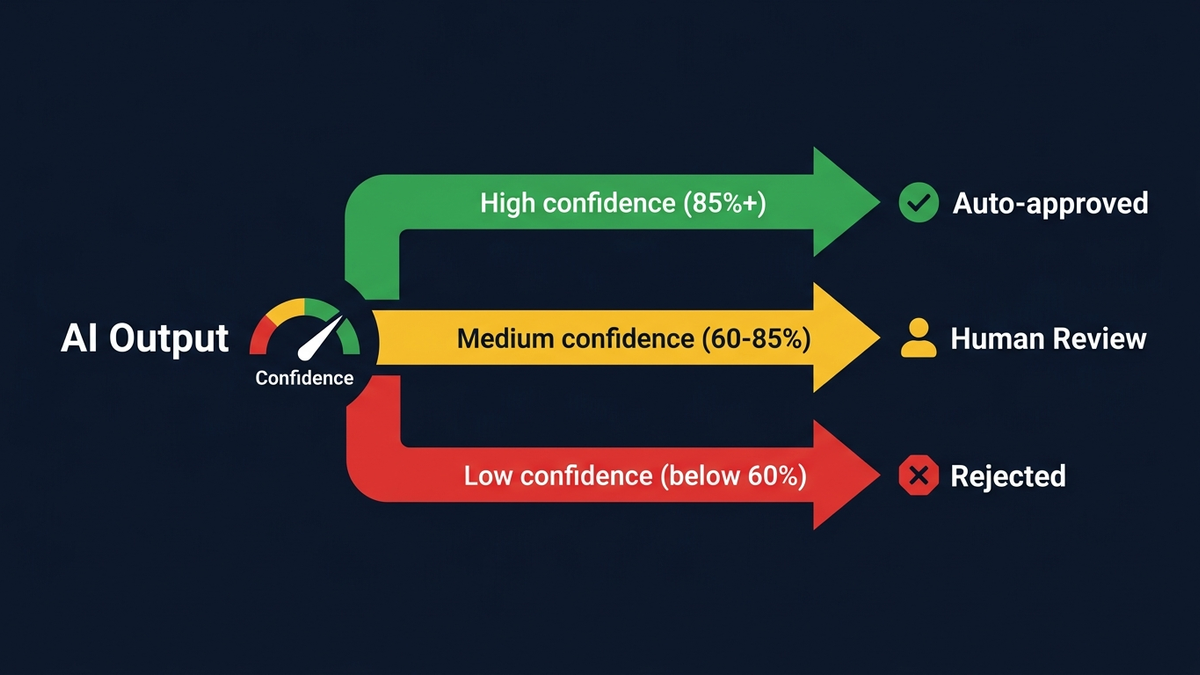

Toda decision de IA en produccion arranca con una pregunta: ?que tan seguro esta el modelo? Los umbrales de confianza traducen esa certeza en accion. La arquitectura estandar utiliza tres niveles. Las salidas por encima de un 0,85–0,95 de confianza se aprueban automaticamente. Puntuaciones entre 0,60 y 0,85 se redirigen a colas de revision humana. Cualquier cosa por debajo de 0,60 se rechaza o dispara una escalacion completa. No son numeros arbitrarios: estan calibrados contra tolerancias de riesgo especificas del dominio y se ajustan de forma continua.

En sistemas basados en LLMs, la confianza suele derivar de log-probabilidades (logprobs), que OpenAI expone a traves de su API de Chat Completions. Un logprob de -0,693 se traduce en aproximadamente un 50% de probabilidad para un token dado. Los ingenieros agregan estos valores a lo largo de los tokens de salida usando metodos como el promedio lineal de probabilidad o puntuaciones de perplejidad. En tareas de clasificacion, el logprob del token de la clase predicha sirve directamente como score de confianza. En sistemas RAG, un patron habitual hace que el modelo genere un booleano has_sufficient_context_for_answer — y el logprob de ese token se convierte en la senal de calidad de la recuperacion.

Pero los logprobs crudos no son fiables sin calibracion. Un modelo que reporta un 90% de confianza podria acertar solo el 70% de las veces — el problema de la “alucinacion segura” que convierte el enrutamiento ingenuo por umbrales en algo peligroso. Tecnicas de calibracion post-hoc como el escalado de temperatura, el escalado de Platt y la regresion isotonica cierran esa brecha mapeando puntuaciones brutas a probabilidades reales. La metrica Expected Calibration Error (ECE) mide que tan bien calibrado esta un modelo: uno bien calibrado que afirme un 80% de confianza deberia acertar aproximadamente el 80% de las veces.

Los profesionales mas experimentados tratan los umbrales como controles de negocio dinamicos, no como configuracion estatica. Rossum, una empresa de IA documental, fija su umbral de automatizacion por defecto en 0,975 — aceptando solo un 2,5% de tasa maxima de error para facturas procesadas automaticamente. Sistemas mas sofisticados varian los umbrales por campo: los numeros de factura exigen una precision casi perfecta mientras que los nombres de proveedores toleran mas flexibilidad. Algunas organizaciones ajustan umbrales segun el contexto — agresivos (0,70) durante el horario laboral normal para maximizar el rendimiento, conservadores (0,90) durante el cierre mensual para priorizar la exactitud. Un enfoque sorprendentemente pragmatico para un campo al que le encanta sobreingeniar las cosas.

La disciplina emergente de la abstencion — ensenar a los modelos a decir “no lo se” — anade una dimension critica. Una encuesta de 2025 en Transactions of the ACL organizo estrategias de abstencion a traves de enfoques basados en prompting, metodos de fine-tuning como R-tuning y aprendizaje por refuerzo con reglas de puntuacion adecuadas. Sin embargo, AbstentionBench, un benchmark 35 veces mayor que los esfuerzos previos, revelo una verdad incomoda: incluso GPT-4 y los modelos de razonamiento avanzado tienen dificultades para reconocer de forma fiable consultas sin respuesta posible. No existe correlacion entre la precision de respuesta de un modelo y su capacidad de abstencion — son capacidades ortogonales que deben ingeniarse por separado. En serio: tu modelo mas inteligente podria ser tambien el mas temerariamente sobreconfiado.

La validacion de salidas atrapa lo que los scores de confianza dejan pasar

Los scores de confianza te dicen que tan seguro esta el modelo. La validacion de salidas te dice si lo que produjo es realmente correcto. Los sistemas en produccion apilan multiples estrategias de validacion, desde la imposicion de estructura hasta la verificacion semantica.

La imposicion de salidas estructuradas ha madurado de forma espectacular. Los structured outputs de proveedores como OpenAI (lanzados en agosto de 2024) logran un 100% de cumplimiento de esquemas JSON mediante decodificacion restringida — el sistema compila un esquema JSON en una gramatica que limita la generacion de tokens en tiempo de inferencia. Antes de esto, incluso GPT-4 producia JSON valido menos del 40% de las veces en esquemas complejos. Anthropic siguio con su propia beta de structured outputs en noviembre de 2025, ofreciendo tanto modo JSON como uso estricto de herramientas con decodificacion restringida en los modelos Claude. Librerias cross-provider como Instructor y LiteLLM abstraen estas capacidades detras de interfaces unificadas basadas en Pydantic, haciendo que la imposicion de esquemas sea agnostica del proveedor.

Mas alla de la correccion estructural, la validacion de contenido requiere un enfoque por capas. El patron de produccion que ha emergido en toda la industria sigue un pipeline de cinco etapas:

- Validacion de entrada detecta ataques de inyeccion de prompts, identifica datos personales (PII) e impone limites tematicos.

- Validacion de recuperacion (en sistemas RAG) filtra fragmentos irrelevantes y enmascara datos sensibles antes de que lleguen al modelo.

- Restricciones de generacion aplican salidas estructuradas y controles de temperatura.

- Validacion de salida verifica toxicidad, alucinaciones y cumplimiento de formato.

- Monitorizacion rastrea la deriva de confianza y retroalimenta las correcciones al sistema.

Tres frameworks de guardrails de codigo abierto dominan este espacio. Los NeMo Guardrails de NVIDIA utilizan Colang, un lenguaje de dominio especifico para definir flujos conversacionales y railes de seguridad, soportando railes de entrada, salida, dialogo, recuperacion y ejecucion con deteccion acelerada por GPU que logra latencias por debajo del segundo a traves de cinco guardrails en paralelo. Guardrails AI se centra en validadores de salida componibles a traves de su Hub — chequeos preconstruidos para coincidencia de regex, validacion de longitud, deteccion de PII y puntuacion de toxicidad que envuelven las llamadas al LLM y validan las salidas automaticamente. El Llama Guard 3 de Meta ofrece clasificacion de seguridad multimodal en 14 categorias de dano, desplegable on-premise para entornos con datos sensibles. Para seguridad especifica de agentes, el LlamaFirewall de Meta (mayo de 2025) utiliza clasificadores basados en ML para deteccion de inyeccion de prompts, verificacion de alineamiento y analisis de seguridad de codigo, logrando una reduccion superior al 90% en las tasas de exito de ataques en benchmarks de agentes.

La deteccion de alucinaciones sigue siendo el reto de validacion mas dificil. Los mejores modelos alcanzan ahora tasas de alucinacion por debajo del 1% en benchmarks de resumen — el Gemini-2.0-Flash de Google lidera con un 0,7% — pero las tasas de alucinacion en conocimiento general promedian alrededor del 9,2%. RAG reduce las alucinaciones entre un 40 y un 71%, aunque los investigadores han demostrado matematicamente que eliminar las alucinaciones por completo es imposible con las arquitecturas LLM actuales. Los sistemas en produccion combinan multiples metodos de deteccion: pipelines de Chain-of-Verification que generan y responden de forma independiente preguntas de verificacion (reduciendo las alucinaciones hasta en un 53%), entropia semantica que agrupa respuestas formuladas de distintas maneras para medir la incertidumbre a nivel de significado, y sondeo de atencion entre capas que detecta alucinaciones en tiempo real usando clasificadores ligeros sobre las activaciones del modelo.

Cuando la IA debe ceder el paso a los humanos — y como hacer la transicion limpia

La tasa optima de escalamiento humano en sistemas en produccion se situa en el 10–15% del total de decisiones. Por debajo de eso, probablemente estas automatizando tareas que no deberian automatizarse. Por encima del 20%, tienes un cuello de botella. Por encima del 60%, tu sistema necesita una recalibracion de raiz.

Los disparadores de escalamiento se dividen en tres categorias. Los disparadores basados en confianza redirigen las salidas de baja puntuacion a colas de revision. Los disparadores basados en reglas siempre escalan condiciones especificas — importes financieros que superan un umbral, acciones que afectan a multiples usuarios, tipos de tarea que aparecen por primera vez o salidas que contradicen decisiones previas para el mismo usuario. Los disparadores de matriz de riesgo evaluan cuatro dimensiones de forma simultanea: irreversibilidad de la accion, radio de explosion de un error potencial, exposicion regulatoria y confianza del modelo. La combinacion determina si se necesita revision humana, no un solo factor aislado.

La arquitectura del traspaso importa tanto como la logica de activacion. Tres patrones dominan en produccion:

- Aprobacion previa a la accion pausa la ejecucion antes de acciones irreversibles y presenta la accion propuesta con su razonamiento para que un humano decida.

- Auditoria posterior a la accion permite que la IA actue de inmediato en decisiones reversibles mientras los humanos muestrean y revisan despues.

- Enrutamiento basado en confianza automatiza la decision entre estos dos modos.

La funcion interrupt() de LangGraph se ha convertido en una opcion de implementacion popular, pausando la ejecucion del grafo a mitad del flujo de trabajo, esperando la entrada humana y reanudando de forma limpia. Para flujos asincronos, herramientas como HumanLayer redirigen las decisiones a canales de Slack, correo electronico o dashboards para revision no bloqueante.

El bucle de retroalimentacion desde las correcciones humanas de vuelta a la mejora del modelo es donde los sistemas HITL generan valor compuesto. Cuando los revisores degradan sistematicamente las salidas por la misma razon, se dispara una revision de prompts o cambios en el preprocesamiento. Cuando una clase de tarea siempre requiere intervencion, es senal de que esa tarea aun no deberia automatizarse. AWS demostro una reduccion del 80% en la carga de trabajo de expertos en la materia combinando RLHF con RLAIF — la IA genera evaluaciones iniciales y los humanos verifican en lugar de crear desde cero. Cursor procesa 400 millones de solicitudes diarias para su funcion Tab y ejecuta un pipeline de RL en linea que se actualiza en funcion de las tasas de aceptacion de los usuarios en cuestion de horas, produciendo un aumento del 28% en la aceptacion de codigo.

Patrones especificos de dominio que funcionan en la practica

Las implementaciones reales de HITL revelan patrones fascinantes segun el dominio. En servicios financieros, el agente de politicas de Ramp gestiona de forma autonoma mas del 65% de las aprobaciones de gastos, pero cada nueva capacidad pasa primero por pruebas en modo sombra — el agente predice acciones mientras un juez LLM compara las predicciones contra las decisiones humanas reales, y solo entra en produccion tras alcanzar los umbrales de precision.

En el sector sanitario, los lectores de radiologia asistidos por IA mejoraron su precision diagnostica de puntuaciones kappa de 0,6 a 0,9, igualando a radiologos especialistas. Pero aqui viene el dato incomodo: los endoscopistas que usaron IA durante tres meses vieron como sus tasas de deteccion caian tras desactivar la IA. El riesgo de descualificacion profesional es real, y nadie tiene todavia una buena respuesta para ello.

En tecnologia legal, la IA revisa contratos un 80% mas rapido que los humanos con un 94% de precision. Suena estupendo hasta que descubres que solo el 68% de las respuestas contractuales de GPT-4 fueron consideradas “practicamente viables” por expertos legales — lo que hace que la supervision humana sea innegociable para el trabajo juridico con consecuencias reales.

Las trazas de auditoria no son opcionales — son legalmente obligatorias

El Articulo 12 de la Ley de IA de la UE exige que los sistemas de IA de alto riesgo permitan tecnicamente el registro automatico de eventos durante toda la vida util del sistema, con logs resistentes a manipulaciones y retenidos durante un minimo de seis meses. El Articulo 26 obliga a los responsables del despliegue a asignar la supervision humana a personas competentes y a monitorizar el funcionamiento del sistema. Las sanciones alcanzan los 35 millones de euros o el 7% de la facturacion global. No son requisitos futuros: las normas de gobernanza y las obligaciones para IA de proposito general entraron en vigor en agosto de 2025, y las reglas para sistemas de alto riesgo seran plenamente aplicables en agosto de 2026.

El Articulo 22 del RGPD anade otra capa: los interesados tienen derecho a no ser objeto de decisiones basadas unicamente en tratamientos automatizados que produzcan efectos juridicos o igualmente significativos. Cualquier sistema de IA que tome decisiones con consecuencias sobre personas — aprobacion de prestamos, contratacion, fijacion de precios de seguros — debe proporcionar mecanismos de intervencion humana, explicaciones de la logica aplicada y la posibilidad de que los individuos impugnen las decisiones.

El ecosistema de herramientas de observabilidad ha madurado para cubrir estos requisitos. Las Convenciones Semanticas GenAI de OpenTelemetry (v1.37+) se han consolidado como el estandar de la industria para telemetria de LLMs, definiendo atributos comunes como gen_ai.request.model, gen_ai.usage.input_tokens y gen_ai.provider.name entre proveedores. LLM Observability de Datadog soporta nativamente las convenciones GenAI de OTel, correlacionando spans de LLM con trazas APM tradicionales. Phoenix de Arize AI, de codigo abierto, utiliza la especificacion OpenInference construida sobre OpenTelemetry. LangSmith captura arboles de ejecucion completos incluyendo selecciones de herramientas, documentos recuperados y los parametros exactos en cada paso, con colas de anotacion que permiten a los expertos de dominio revisar y etiquetar trazas.

Los equipos en produccion suelen registrar un conjunto exhaustivo de metadatos por cada llamada de inferencia:

- Contenido completo de entrada/salida (o hashes criptograficos para datos sensibles)

- Nombre y version del modelo

- ID y version de la plantilla de prompt

- Conteos de tokens desglosados por entrada, salida, tokens en cache y tokens de razonamiento

- Coste calculado y metricas de latencia (duracion total, tiempo hasta el primer token, tiempo de procesamiento del LLM)

- Temperatura y parametros de muestreo

- Razon de finalizacion

- IDs de traza y span para trazado distribuido

- Metadatos de negocio como ID de usuario, entorno, grupo de test A/B y feature flags

El versionado de prompts se ha convertido en una disciplina de ingenieria de primer nivel. La mejor practica sigue el versionado semantico (major.minor.patch), con versiones inmutables — una vez creada, una version de prompt no se modifica jamas. Los cambios crean nuevas versiones desplegadas mediante promocion basada en entornos (dev → staging → production), con cada traza de produccion vinculada a la version exacta del prompt utilizado. Herramientas como LangSmith, Langfuse, Braintrust y Helicone soportan este patron de forma nativa. ISO 42001, el primer estandar certificable del mundo para sistemas de gestion de IA, ha sido adoptado por Microsoft, Google Cloud y AWS, estableciendo las expectativas base de gobernanza para la IA empresarial.

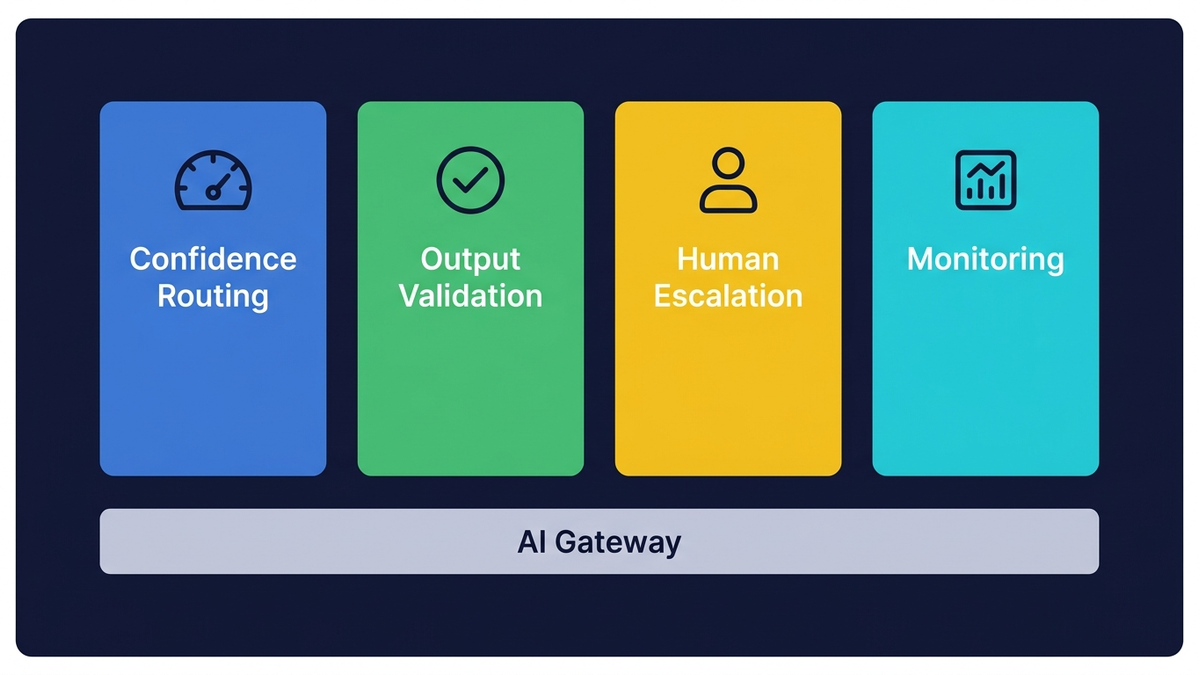

Como los cuatro pilares se conectan en una capa de fiabilidad unificada

Estos componentes no operan de forma aislada. La arquitectura de referencia que esta emergiendo en los despliegues en produccion los apila en un sistema por capas:

- La capa de aplicacion gestiona feature flags, enrutamiento canary y pruebas A/B para cambios de prompts.

- La capa de AI gateway — implementada mediante herramientas como Portkey (procesando mas de 10.000 millones de solicitudes mensuales), LiteLLM o TensorZero — gestiona enrutamiento multi-proveedor, limitacion de tasa, cache, circuit breakers y observabilidad.

- La capa de guardrails impone la validacion de entradas y salidas mediante NeMo Guardrails, Guardrails AI, Llama Guard u opciones nativas en la nube como AWS Bedrock Guardrails.

- La capa de evaluacion ejecuta verificaciones CI/CD mediante DeepEval y Promptfoo, escaneos de red-team pre-despliegue y monitorizacion continua en produccion.

Los circuit breakers adaptados para sistemas de IA anaden un patron de resiliencia critico. A diferencia de los circuit breakers tradicionales que saltan por errores HTTP, los circuit breakers de IA tambien deben rastrear fallos de calidad— si un LLM devuelve JSON malformado o datos alucinados tres veces consecutivas, el circuito salta aunque las llamadas a la API tecnicamente “funcionaron.” Cox Automotive implementa limites duros: las conversaciones que superan los 20 turnos o cuyos costes alcanzan umbrales del percentil 95 disparan un traspaso automatico y ordenado a agentes humanos.

La caida multi-proveedor de diciembre de 2024, cuando OpenAI quedo inaccesible durante cuatro horas mientras Claude y Gemini se degradaban simultaneamente, valido la necesidad de cadenas de degradacion elegante. La jerarquia estandar recorre cinco niveles: modelo principal a modelo mas barato/rapido, a respuestas en cache, a heuristicas basadas en reglas, a escalamiento humano. El sistema de programacion de vuelos de una aerolinea sobrevivio a una caida de nube cambiando a un optimizador heuristico (valido en el 90% de los casos), luego a un motor de reglas para restricciones simples, derivando el 5% restante a revision manual — cero vuelos cancelados. Esa es la clase de ingenieria de resiliencia que separa los sistemas de produccion de los proyectos de laboratorio.

Los despliegues canary para cambios de prompts siguen la misma logica que los canary de codigo, pero anaden monitorizacion especifica de IA. Las nuevas versiones de prompt reciben entre el 1 y el 5% del trafico de produccion mientras se rastrean metricas de calidad — no solo tasas de error. Los cambios de prompts pueden tener impactos sutiles en la calidad que resultan invisibles en metricas de salud del sistema, lo que requiere ventanas de observacion mas largas para alcanzar significancia estadistica. Solo tras confirmar la calidad se incrementa gradualmente el trafico hasta el 100%.

Lecciones de los equipos que lo estan haciendo bien

La leccion mas clara de produccion es que el cuello de botella es la ingenieria, no la inteligencia. Los equipos que entregan sistemas LLM fiables se parecen a los equipos que entregan cualquier otra infraestructura critica: disciplinados con los modos de fallo, rigurosos con la evaluacion y pragmaticos sobre que componentes necesitan ser a prueba de balas. Ramp prueba en modo sombra cada nueva capacidad de IA contra transacciones financieras reales sin arriesgar un solo dolar. Stripe construyo un modelo fundacional especifico de dominio que mejoro la deteccion de fraude con tarjetas de prueba de un 59% a un 97% de precision mientras recuperaba 6.000 millones de dolares en pagos legitimos. Shopify sirve 30 millones de predicciones diarias en mas de 10.000 categorias de producto con una tasa de aceptacion de comerciantes del 85%.

Gartner predice que el 40% de los proyectos de IA agentica se cancelaran para 2027 debido a costes crecientes, valor de negocio difuso o controles de riesgo inadecuados. Los supervivientes seran los equipos que trataron los guardrails como infraestructura central desde el primer dia — sacando la logica de seguridad de los prompts y llevandola al codigo, donde las restricciones arquitectonicas ofrecen garantias que la ingenieria de prompts jamas podra dar.

Los guardrails no te frenan — hacen que sea seguro ir rapido

La fiabilidad de la IA en produccion esta convergiendo hacia un patron arquitectonico claro: enrutamiento consciente de la confianza, validacion por capas, escalamiento humano estructurado y observabilidad integral — todo orquestado a traves de AI gateways que sirven como plano de control centralizado. El cambio mas significativo de 2024–2025 ha sido el movimiento sistematico de la logica de seguridad desde los prompts hacia la infraestructura.

Las organizaciones con marcos de gobernanza maduros logran un time-to-production 3 veces mas rapidopara nuevas funcionalidades de IA, no a pesar de los guardrails sino gracias a ellos. Solo ese dato deberia zanjar para siempre cada argumento de “los guardrails nos ralentizan” en cada reunion de planificacion. La ingenieria es el producto. Los guardrails son la funcionalidad.