Між вау-ефектом на демо і продакшн-системою, яка не ламається о третій ночі, стоїть одне слово: запобіжники. Організації, що масштабують LLM, вже набили гулі — дорогі й гучні — і засвоїли просту річ: сира інтелектуальна потужність моделі не дорівнює надійності. Аналіз 1 200 продакшн-розгортань LLM показав: найуспішніші команди інженерять систему навколо моделі, а не чекають, поки модель стане розумнішою. Водночас 68% організацій, що впровадили LLM без належних запобіжників, зафіксували інциденти безпеки у 2024 році, а за оцінками Forrester глобальні фінансові втрати від вигаданих ШІ-відповідей сягнули $67,4 млрд того ж року. Команди, які випускають надійні ШІ-системи, ставляться до запобіжників як до інфраструктури, а не до запізнілого доповнення.

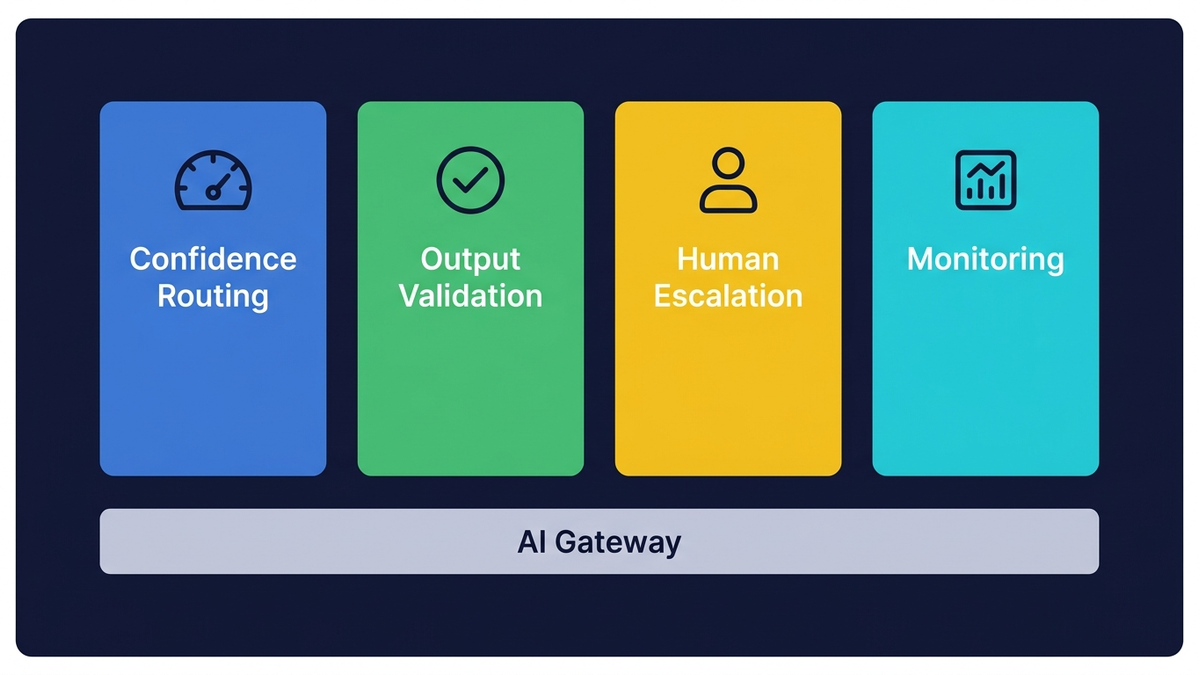

Чотири інженерні стовпи тримають надійний продакшн-ШІ. Порогові значення впевненості — щоб система знала, коли відступити. Валідація виходу — щоб гарантувати коректність. Ескалація з підключенням людини — щоб ловити те, що автоматизація пропускає. І журнали аудиту — щоб кожне рішення було відстежуваним. Далі — як провідні інженерні команди збирають це докупи в системи, що реально працюють.

Оцінки впевненості визначають, що автоматизується, а що — ні

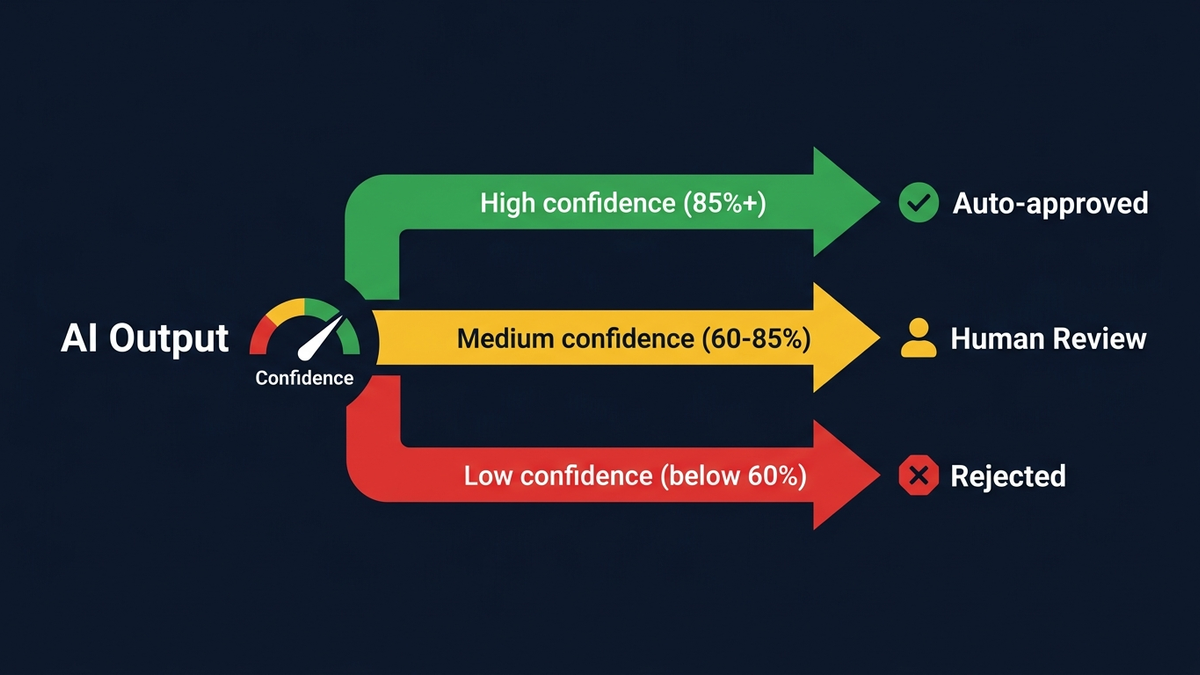

Будь-яке рішення продакшн-ШІ стартує з одного питання: наскільки модель впевнена у собі? Порогові значення впевненості перетворюють цю впевненість на дію. Стандартна архітектура використовує три рівні. Відповіді з впевненістю вище 0,85–0,95 проходять автоматично. Оцінки між 0,60 і 0,85 потрапляють у чергу на перевірку людиною. Все, що нижче 0,60, відхиляється або запускає повну ескалацію. Це не довільні цифри — вони калібруються під допустимий рівень ризику конкретного домену і коригуються безперервно.

Для LLM-систем впевненість зазвичай обчислюється з логарифмів ймовірностей (logprobs), які OpenAI надає через Chat Completions API. Logprob -0,693 означає приблизно 50% ймовірність для конкретного токена. Інженери агрегують їх по вихідних токенах методами на кшталт лінійного усереднення ймовірностей чи оцінки перплексії. У задачах класифікації logprob передбаченого класу безпосередньо слугує оцінкою впевненості. У RAG-системах поширений патерн — модель генерує булеве значення has_sufficient_context_for_answer, а logprob цього токена стає сигналом якості пошуку.

От тільки сирі logprobs без калібрування — як спідометр без повірки. Модель заявляє 90% впевненості, а правильна лише в 70% випадків. Це проблема “впевненої галюцинації”, і через неї наївна маршрутизація за порогами стає небезпечною. Техніки постфактумного калібрування — температурне масштабування, калібрування Платта, ізотонна регресія — закривають цей розрив, проєктуючи сирі оцінки на реальні ймовірності. Метрика Expected Calibration Error (ECE) показує, наскільки добре відкалібрована модель: якщо вона заявляє 80% впевненості, то й помилятися повинна приблизно у 20% випадків.

Досвідчені практики давно зрозуміли: пороги — це динамічні бізнес-контроли, а не рядок у конфігу, який хтось виставив і забув. Приклад: Rossum, компанія у сфері документного ШІ, тримає поріг автоматизації за замовчуванням на 0,975 — допускаючи максимум 2,5% помилок для автоматично оброблених рахунків-фактур. Складніші системи варіюють пороги по полях: номери рахунків вимагають майже ідеальної точності, тоді як назви постачальників допускають більше гнучкості. Деякі організації змінюють пороги залежно від контексту — агресивні (0,70) у робочі години заради пропускної здатності, консервативні (0,90) під час закриття місяця заради точності. Для галузі, що обожнює переускладнювати речі, — напрочуд прагматичний підхід.

А ось ще один напрямок, що набирає обертів: утримання від відповіді. Простіше кажучи — навчити модель казати “я не знаю”. Огляд 2025 року у Transactions of the ACL систематизував стратегії утримання: підходи на основі промптів, методи дотюнінгу на кшталт R-tuning і навчання з підкріпленням із правильними оцінювальними функціями. Але бенчмарк AbstentionBench, у 35 разів масштабніший за попередні спроби, виявив тверезу правду: навіть GPT-4 і просунуті моделі міркування ненадійно розпізнають питання без відповіді. Кореляції між точністю відповідей моделі та її здатністю утриматись від відповіді не існує — це ортогональні навички, які треба розвивати окремо. Серйозно? Так: ваша найрозумніша модель може водночас бути найбільш безрозсудно самовпевненою.

Валідація виходу ловить те, що оцінки впевненості пропускають

Оцінка впевненості — це про те, наскільки модель вірить у себе. Валідація виходу — про те, чи вона насправді правильна. Різниця принципова. Продакшн-системи нашаровують кілька стратегій валідації — від структурного контролю до семантичної верифікації.

Структурний контроль виходу пройшов величезний шлях. Структуровані відповіді від провайдерів на кшталт OpenAI (запущені у серпні 2024) дають 100% відповідність JSON-схемі через обмежене декодування — система компілює JSON-схему у граматику, що обмежує генерацію токенів під час інференсу. До цього навіть GPT-4 видавав валідний JSON менш ніж у 40% випадків на складних схемах. Anthropic наступним випустив власну бету структурованих відповідей у листопаді 2025, запропонувавши JSON-режим і строге використання інструментів з обмеженим декодуванням на моделях Claude. Кросплатформні бібліотеки Instructor і LiteLLM тепер абстрагують ці можливості за єдиними інтерфейсами на основі Pydantic, роблячи контроль схеми незалежним від провайдера.

Окрім структурної коректності, валідація контенту потребує багатошарового підходу. Виробничий патерн, що склався в індустрії, — п'ятиетапний конвеєр:

- Валідація входуперехоплює атаки ін'єкції промптів, виявляє персональні дані і контролює тематичні межі.

- Валідація пошуку (у RAG-системах) фільтрує нерелевантні фрагменти й маскує чутливі дані до того, як вони потраплять до моделі.

- Обмеження генерації застосовують структуровані відповіді та контроль температури.

- Валідація виходу перевіряє токсичність, галюцинації та відповідність формату.

- Моніторинг відстежує дрейф впевненості й повертає корекції назад у систему.

Три фреймворки з відкритим кодом домінують у цьому просторі. NeMo Guardrails від NVIDIA використовує Colang — предметно-орієнтовану мову для опису діалогових потоків і захисних рейок — з підтримкою вхідних, вихідних, діалогових, пошукових і виконавчих рейок та GPU-прискореним виявленням, що забезпечує субсекундну затримку для п'яти паралельних запобіжників. Guardrails AI зосереджується на компонованих валідаторах виходу через свій Hub — готові перевірки для регулярних виразів, валідації довжини, виявлення персональних даних і оцінки токсичності, що обгортають виклики LLM і валідують відповіді автоматично. Llama Guard 3 від Meta забезпечує мультимодальну класифікацію безпеки за 14 категоріями шкоди з можливістю розгортання на власних серверах для середовищ із чутливими даними. Для безпеки агентів Meta випустила LlamaFirewall (травень 2025) — ML-класифікатори для виявлення ін'єкцій промптів, перевірки вирівнювання й аналізу безпеки коду, що забезпечують зниження успішності атак понад 90% на бенчмарках агентів.

Галюцинації. Ось де справжній біль. Найкращі моделі тепер видають менше 1% галюцинацій на бенчмарках узагальнення — Gemini-2.0-Flash від Google лідирує з показником 0,7% — але на задачах загальних знань середній показник тримається біля 9,2%. RAG зменшує галюцинації на 40–71%, проте дослідники математично довели: повністю усунути галюцинації неможливо за поточних архітектур LLM. Продакшн-системи комбінують кілька методів виявлення: конвеєри Chain-of-Verification, що генерують і незалежно відповідають на верифікаційні питання (зниження галюцинацій до 53%), семантичну ентропію, що кластеризує по-різному сформульовані відповіді для вимірювання невизначеності на рівні значень, і зондування міжшарової уваги, що позначає галюцинації в реальному часі за допомогою легких класифікаторів на активаціях моделі.

Коли ШІ має передати справу людині — і як зробити цей перехід чистим

Золотий діапазон ескалацій з підключенням людини у продакшн-системах — 10–15% від усіх рішень. Менше? Ви, скоріше за все, автоматизуєте те, що автоматизувати не варто. Більше 20% — маєте вузьке місце. Більше 60% — систему треба перебудовувати з нуля.

Три категорії тригерів ескалації. Перша — на основі впевненості: низькі оцінки відправляють відповідь у чергу на перевірку. Друга — на основі правил: фінансові суми вище порогу, дії, що впливають на кількох користувачів, типи задач, що виконуються вперше, або відповіді, що суперечать попереднім рішенням для того ж користувача — ескалюються завжди. Третя — ризик-матриця, що оцінює чотири виміри одночасно: незворотність дії, радіус ураження потенційної помилки, ризики відповідності та впевненість моделі. Вирішує саме комбінація факторів, а не якийсь один окремо.

Але тригери — це половина справи. Архітектура самої передачі не менш важлива. Три патерни домінують у продакшні:

- Попереднє схвалення призупиняє виконання перед незворотними діями і показує людині запропоновану дію з обґрунтуванням для прийняття рішення.

- Постфактумний аудит дозволяє ШІ діяти негайно на зворотних рішеннях, а люди вибірково перевіряють потім.

- Маршрутизація за впевненістю автоматизує вибір між двома попередніми режимами.

Функція interrupt() у LangGraph стала популярним вибором для реалізації — вона призупиняє виконання графа посеред робочого потоку, чекає на рішення людини і продовжує роботу. Для асинхронних сценаріїв інструменти на кшталт HumanLayer маршрутизують рішення у Slack-канали, на пошту чи в дашборди для неблокуючої перевірки.

А тепер — про найцікавіше. Зворотний зв'язок від людських корекцій назад у покращення моделі. Саме тут системи з людиною в контурі починають працювати як маховик — цінність наростає з кожною ітерацією. Коли ревюери систематично знижують оцінки відповідей з однієї причини, це запускає ревізію промптів або зміни у попередній обробці. Коли клас задач постійно вимагає втручання — це сигнал, що його поки не варто автоматизувати. AWS продемонстрував зниження навантаження на предметних експертів на 80% завдяки поєднанню RLHF із RLAIF — ШІ генерує початкові оцінки, а люди верифікують, а не створюють з нуля. Cursor обробляє 400 мільйонів запитів щодня для функції Tab і запускає конвеєр онлайн-навчання з підкріпленням, що оновлюється на основі показників прийняття користувачами за лічені години, забезпечуючи зростання прийняття коду на 28%.

Доменні патерни, що працюють на практиці

Реальні впровадження з людиною в контурі — окрема захоплива тема. У фінансах агент політик Ramp закриває понад 65% схвалень витрат автономно, але кожна нова функціональність спершу проходить тіньове тестування — агент прогнозує дії, а суддя-LLM порівнює прогнози з реальними рішеннями людей; у продакшн система потрапляє лише після досягнення порогів точності.

У медицині радіологи з ШІ-асистентом підняли діагностичну точність із каппа-оцінки 0,6 до 0,9 — на рівні вузькоспеціалізованих радіологів. Але далі — незручне: ендоскопісти, що три місяці працювали з ШІ, показали зниження показників виявлення після вимкнення ШІ. Ризик деградації навичок реальний, і переконливої відповіді на це поки ні в кого немає.

У юридичних технологіях ШІ аналізує контракти на 80% швидше за людей із точністю 94%. Вражає? Поки не дізнаєтесь, що лише 68% відповідей GPT-4 щодо контрактів юридичні експерти визнали “практично придатними”. Тож людський контроль у відповідальній юридичній роботі — не опція, а необхідність.

Журнали аудиту — це не “було б непогано”, а вимога закону

Стаття 12 Акту ЄС про ШІ вимагає, щоб високоризикові ШІ-системи технічно забезпечували автоматичну реєстрацію подій протягом усього терміну служби системи з журналами, захищеними від підробки, що зберігаються мінімум шість місяців. Стаття 26 зобов'язує операторів призначати людський нагляд компетентним особам і моніторити роботу системи. Штрафи сягають €35 мільйонів або 7% глобального обороту. Це не майбутні вимоги — правила управління та зобов'язання щодо ШІ загального призначення набули чинності у серпні 2025, а норми для високоризикових систем повністю запрацюють до серпня 2026.

Стаття 22 GDPR додає ще один шар: суб'єкти даних мають право не підлягати рішенням, що базуються виключно на автоматизованій обробці та мають юридичні або аналогічні значущі наслідки. Будь-яка ШІ-система, що приймає відповідальні рішення щодо осіб — схвалення кредитів, найм, ціноутворення страхування — повинна забезпечувати механізми людського втручання, пояснення задіяної логіки та можливість оскарження рішень.

Добра новина: екосистема інструментів спостережності вже дозріла під ці вимоги. Семантичні конвенції GenAI від OpenTelemetry (v1.37+) стали індустріальним стандартом для телеметрії LLM, визначаючи спільні атрибути на кшталт gen_ai.request.model, gen_ai.usage.input_tokens і gen_ai.provider.name між провайдерами. LLM Observability від Datadog нативно підтримує конвенції OTel GenAI, корелюючи LLM-спани з традиційними APM-трейсами. Phoenix від Arize AI — інструмент з відкритим кодом — використовує специфікацію OpenInference, побудовану на OpenTelemetry. LangSmith зберігає повні дерева виконання, включно з вибором інструментів, знайденими документами та точними параметрами на кожному кроці, з чергами анотацій для перевірки й маркування трейсів предметними експертами.

Що саме логують продакшн-команди на кожен виклик інференсу? Ось типовий набір:

- Повний вміст входу/виходу (або криптографічні хеші для чутливих даних)

- Назва й версія моделі

- Ідентифікатор і версія шаблону промпту

- Кількість токенів з розбивкою на вхідні, вихідні, кешовані та токени міркування

- Розраховані вартість і метрики затримки (загальна тривалість, час до першого токена, час обробки LLM)

- Температура та параметри семплювання

- Причина завершення

- Ідентифікатори трейсу й спану для розподіленого трейсингу

- Бізнес-метадані: ідентифікатор користувача, середовище, група A/B-тесту, прапорці функцій

Версіонування промптів стало повноцінною інженерною дисципліною. Найкращі практики слідують семантичному версіонуванню (major.minor.patch) з незмінними версіями — створена версія промпту ніколи не модифікується. Зміни створюють нові версії, що розгортаються через просування по середовищах (dev → staging → production), а кожен продакшн-трейс прив'язується до точної версії промпту. Інструменти LangSmith, Langfuse, Braintrust і Helicone підтримують цей патерн нативно. ISO 42001 — перший у світі сертифікований стандарт системи управління ШІ — прийнятий Microsoft, Google Cloud і AWS, встановлюючи базові очікування щодо управління ШІ на підприємстві.

Як чотири стовпи з'єднуються в єдиний шар надійності

Ці компоненти не живуть кожен сам по собі. Референтна архітектура, що викристалізувалась із реальних продакшн-розгортань, укладає їх у багатошарову систему:

- Шар застосунку керує прапорцями функцій, канарковою маршрутизацією та A/B-тестуванням змін промптів.

- Шар ШІ-шлюзу — реалізований через Portkey (обробляє понад 10 мільярдів запитів на місяць), LiteLLM або TensorZero — керує маршрутизацією між провайдерами, обмеженням частоти запитів, кешуванням, розмикачами ланцюга та спостережністю.

- Шар запобіжників забезпечує валідацію входу й виходу через NeMo Guardrails, Guardrails AI, Llama Guard або хмарні рішення на кшталт AWS Bedrock Guardrails.

- Шар оцінювання виконує перевірки у CI/CD через DeepEval і Promptfoo, сканування red-team перед деплоєм і безперервний моніторинг у продакшні.

Окрема історія — розмикачі ланцюга, адаптовані під ШІ. Традиційні спрацьовують на HTTP-помилки. Але тут складніше: ШІ-розмикачі ланцюга мають також відстежувати збої якості— якщо LLM тричі поспіль повертає невалідний JSON або вигадані дані, ланцюг розмикається, навіть якщо API-виклики технічно “успішні”. Cox Automotive впровадив жорсткі обмеження: розмови довше 20 реплік або витрати, що досягають порогу P95, автоматично запускають коректну передачу справи живому оператору.

Масштабний збій кількох провайдерів у грудні 2024, коли OpenAI лягла на чотири години, а Claude і Gemini деградували одночасно, підтвердив необхідність ланцюгів плавної деградації. Стандартна ієрархія проходить п'ять рівнів: основна модель → дешевша/швидша модель → кешовані відповіді → евристики на правилах → ескалація на людину. Система планування авіакомпанії пережила хмарний збій, переключившись на евристичний оптимізатор (валідний у 90% випадків), потім на движок правил для простих обмежень, а решту 5% позначивши для ручної обробки. Результат? Жодного скасованого рейсу. Ось це і є та межа, що відділяє продакшн-системи від лабораторних прототипів.

Канаркові розгортання для змін промптів слідують тій самій логіці, що й канаркові релізи коду, але з ШІ-специфічним моніторингом. Нові версії промптів отримують 1–5% продакшн-трафіку, поки відстежуються метрики якості, а не лише рівень помилок. Зміни промптів можуть мати тонкий вплив на якість, невидимий у метриках здоров'я системи, що потребує довших вікон спостереження для статистичної значущості. Трафік піднімається до 100% лише після підтвердження якості.

Уроки від команд, які роблять це правильно

Головний урок із продакшну простий і болючий: вузьке місце — це інженерія, а не інтелект моделі. Команди, що випускають надійні LLM-системи, нічим не відрізняються від команд, що будують будь-яку іншу критичну інфраструктуру. Та сама дисципліна щодо режимів відмови. Та сама суворість в оцінюванні. Той самий прагматизм щодо того, що має бути куленепробивним. Ramp тестує кожну нову ШІ-функціональність у тіньовому режимі на реальних фінансових транзакціях, не ризикуючи жодним доларом. Stripe побудувала доменну базову модель, що покращила виявлення шахрайства з тестуванням карток із 59% до 97% точності, одночасно повернувши $6 мільярдів легітимних платежів. Shopify обслуговує 30 мільйонів прогнозів щодня по понад 10 000 категоріях товарів із 85% рівнем прийняття мерчантами.

Gartner прогнозує: 40% проєктів агентного ШІ буде скасовано до 2027 через зростаючі витрати, нечітку бізнес-цінність або неадекватний контроль ризиків. Хто виживе? Ті, хто з першого дня ставились до запобіжників як до основної інфраструктури. Хто виносив логіку безпеки з промптів у код, де архітектурні обмеження дають гарантії, яких промпт-інженерія ніколи не забезпечить.

Запобіжники не гальмують — вони дають змогу рухатись швидко й безпечно

Надійність продакшн-ШІ сходиться до чіткого архітектурного патерну. Маршрутизація з урахуванням впевненості. Багатошарова валідація. Структурована ескалація на людину. Всеохоплююча спостережність. Все це оркестроване через ШІ-шлюзи як центральну площину управління. А найзначніший зсув 2024–2025 — системний перенос логіки безпеки з промптів в інфраструктуру.

Організації зі зрілими системами управління досягають втричі швидшого виходу в продакшндля нових ШІ-функцій. Не всупереч запобіжникам — завдяки їм. Серйозно: одного цього факту достатньо, щоб закрити будь-яку дискусію “запобіжники нас гальмують” на будь-якому плануванні. Назавжди. Інженерія і є продукт. Запобіжники і є функціональність.