Zwischen einer KI-Demo und einem produktionsreifen KI-System steht ein einziges Wort: Guardrails. Organisationen, die LLMs im großen Maßstab betreiben, haben gelernt — häufig durch teure, öffentlich peinliche Ausfälle —, dass rohe Modellintelligenz keine Zuverlässigkeit schafft. Eine Analyse von 1.200 produktiven LLM-Deployments belegt: Die erfolgreichsten Organisationen konstruieren das System um das Modell herum, statt auf ein schlaueres Modell zu warten. Gleichzeitig meldeten 68 % der Unternehmen, die LLMs ohne ausreichende Guardrails einsetzen, Sicherheitsvorfälle im Jahr 2024. Und laut Forrester erreichten die globalen finanziellen Verluste durch halluzinierte KI-Ausgaben im selben Jahr 67,4 Mrd. $. Teams, die zuverlässige KI-Systeme ausliefern, behandeln Guardrails als Infrastruktur — nicht als nachträgliches Add-on.

Vier technische Säulen bilden das Fundament vertrauenswürdiger Produktions-KI: Konfidenzschwellen, die wissen, wann das System zurücktreten muss; Ausgabevalidierung, die Korrektheit erzwingt; Human-in-the-Loop-Eskalation, die auffängt, was Automatisierung übersieht; und Audit-Trails, die jede Entscheidung nachvollziehbar machen. So verbinden führende Engineering-Teams diese Bausteine zu Systemen, die tatsächlich funktionieren.

Konfidenzwerte entscheiden, was automatisiert wird — und was nicht

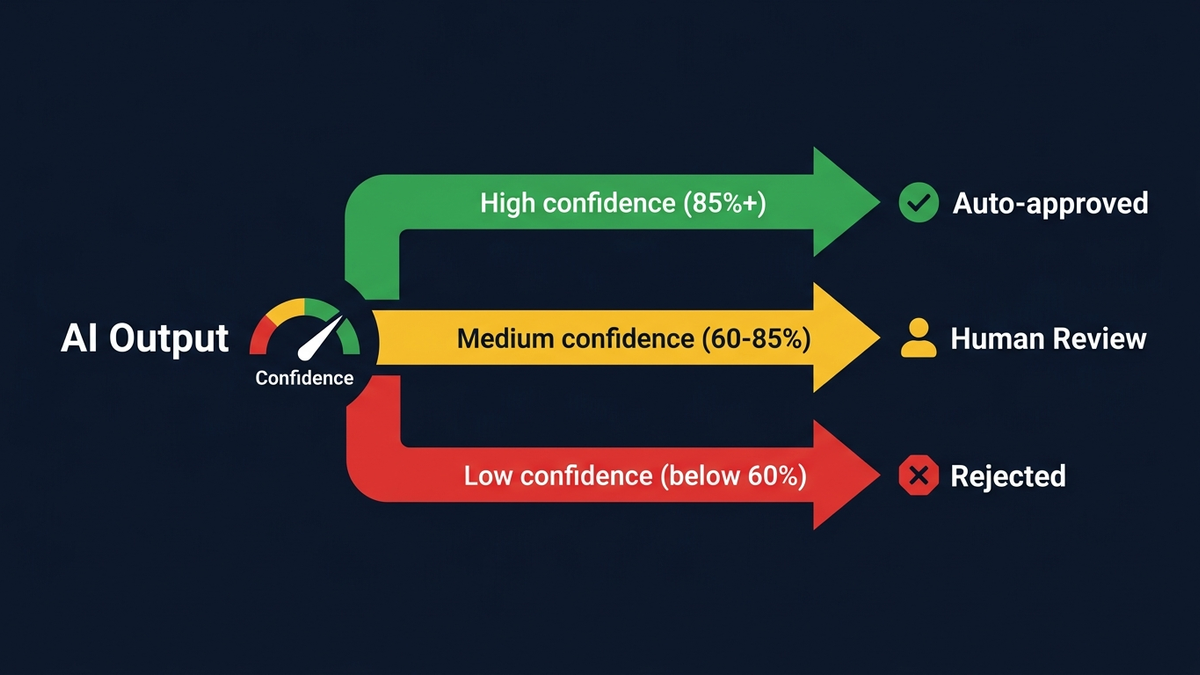

Jede produktive KI-Entscheidung beginnt mit einer Frage: Wie sicher ist das Modell? Konfidenzschwellen übersetzen diese Sicherheit in Handlung. Die Standardarchitektur arbeitet mit drei Stufen: Ausgaben oberhalb von 0,85–0,95 Konfidenz werden automatisch freigegeben. Werte zwischen 0,60 und 0,85landen in einer menschlichen Prüfwarteschlange. Alles unter 0,60 wird abgelehnt oder löst eine vollständige Eskalation aus. Willkürlich gewählt sind diese Zahlen nicht — sie werden gegen domänenspezifische Risikotoleranzen kalibriert und kontinuierlich nachjustiert.

Bei LLM-basierten Systemen leiten sich Konfidenzwerte typischerweise aus Log-Wahrscheinlichkeiten (Logprobs) ab, die OpenAI über seine Chat-Completions-API bereitstellt. Ein Logprob von -0,693 entspricht einer Wahrscheinlichkeit von rund 50 % für ein bestimmtes Token. Engineers aggregieren diese Werte über die Ausgabetokens hinweg — etwa durch lineare Wahrscheinlichkeitsmittelung oder Perplexitätsscores. Bei Klassifikationsaufgaben dient der Logprob des vorhergesagten Klassen-Tokens direkt als Konfidenzwert. In RAG-Systemen hat sich ein Muster bewährt, bei dem das Modell einen has_sufficient_context_for_answer-Boolean ausgibt — der Logprob dieses Tokens wird zum Signal für die Retrieval-Qualität.

Rohe Logprobs sind allerdings ohne Kalibrierung unzuverlässig. Ein Modell, das 90 % Konfidenz meldet, liegt möglicherweise nur in 70 % der Fälle richtig — das Problem der „selbstsicheren Halluzination“, das naives schwellenbasiertes Routing gefährlich macht. Post-hoc-Kalibrierungstechniken wie Temperature Scaling, Platt Scaling und isotonische Regression schließen diese Lücke, indem sie Rohwerte auf tatsächliche Wahrscheinlichkeiten abbilden. Die Metrik Expected Calibration Error (ECE) misst, wie gut ein Modell kalibriert ist: Ein gut kalibriertes Modell, das 80 % Konfidenz beansprucht, sollte in etwa 80 % der Fälle korrekt liegen.

Erfahrene Practitioner behandeln Schwellenwerte als dynamische Geschäftssteuerung, nicht als statische Konfiguration. Rossum, ein Document-AI-Unternehmen, setzt seinen Standard-Automatisierungsschwellenwert auf 0,975— und akzeptiert damit nur eine maximale Fehlerrate von 2,5 % für automatisch verarbeitete Rechnungen. Differenziertere Systeme variieren die Schwellenwerte nach Feld: Rechnungsnummern verlangen nahezu perfekte Genauigkeit, während Lieferantennamen mehr Spielraum vertragen. Manche Organisationen passen Schwellenwerte kontextabhängig an — aggressiv (0,70) während normaler Geschäftszeiten für Durchsatz, konservativ (0,90) zum Monatsabschluss für Genauigkeit. Ein überraschend pragmatischer Ansatz für ein Feld, das gerne überkonstruiert.

Die aufkommende Disziplin der Enthaltung — Modellen beizubringen, „Ich weiß es nicht“ zu sagen — fügt eine entscheidende Dimension hinzu. Eine Studie aus 2025 in Transactions of the ACL systematisierte Enthaltungsstrategien über Prompting-basierte Ansätze, Feintuning-Methoden wie R-Tuning und Reinforcement Learning mit geeigneten Scoring-Regeln. Doch AbstentionBench — ein Benchmark, der 35-mal umfangreicher ist als bisherige Ansätze — offenbarte eine ernüchternde Wahrheit: Selbst GPT-4 und fortgeschrittene Reasoning-Modelle scheitern zuverlässig daran, unbeantwortbare Anfragen zu erkennen. Zwischen der Antwortgenauigkeit eines Modells und seiner Fähigkeit zur Enthaltung existiert keinerlei Korrelation— es sind orthogonale Fähigkeiten, die separat konstruiert werden müssen. Ihr intelligentestes Modell könnte zugleich Ihr übermütigstes sein.

Ausgabevalidierung fängt auf, was Konfidenz-Scoring übersieht

Konfidenzwerte verraten, wie sicher das Modell ist. Ausgabevalidierung klärt, ob das Erzeugte tatsächlich korrekt ist. Produktionssysteme schichten mehrere Validierungsstrategien übereinander — von struktureller Erzwingung bis hin zur semantischen Verifikation.

Strukturierte Ausgabeerzwingung hat einen enormen Reifesprung gemacht. Structured Outputs von Anbietern wie OpenAI (eingeführt im August 2024) erreichen 100 % JSON-Schema-Konformitätdurch Constrained Decoding — das System kompiliert ein JSON-Schema in eine Grammatik, die die Token-Generierung zur Inferenzzeit einschränkt. Zuvor erzeugte selbst GPT-4 bei komplexen Schemata in weniger als 40 % der Fälle valides JSON. Anthropic folgte mit einer eigenen Structured-Outputs-Beta im November 2025 und bietet sowohl einen JSON-Modus als auch strikte Tool-Nutzung mit Constrained Decoding für Claude-Modelle. Plattformübergreifende Bibliotheken wie Instructor und LiteLLM abstrahieren diese Fähigkeiten hinter einheitlichen Pydantic-basierten Schnittstellen — Schema-Erzwingung wird damit anbieterunabhängig.

Jenseits struktureller Korrektheit erfordert die Inhaltsvalidierung einen mehrschichtigen Ansatz. Das Produktionsmuster, das sich branchenweit etabliert hat, folgt einer fünfstufigen Pipeline:

- Eingabevalidierungfängt Prompt-Injection-Angriffe ab, erkennt personenbezogene Daten und setzt Themengrenzen durch.

- Retrieval-Validierung (in RAG-Systemen) filtert irrelevante Chunks und maskiert sensible Daten, bevor sie das Modell erreichen.

- Generierungseinschränkungen wenden Structured Outputs und Temperature-Kontrollen an.

- Ausgabevalidierungprüft auf Toxizität, Halluzination und Formatkonformität.

- Monitoringverfolgt Konfidenz-Drift und speist Korrekturen zurück ins System.

Drei Open-Source-Guardrails-Frameworks dominieren diesen Bereich. NVIDIAs NeMo Guardrails nutzt Colang, eine domänenspezifische Sprache zur Definition von Dialogflüssen und Sicherheitsschienen. Es unterstützt Eingabe-, Ausgabe-, Dialog-, Retrieval- und Ausführungsschienen mit GPU-beschleunigter Erkennung, die Latenz unter einer Sekunde über fünf parallele Guardrails erreicht. Guardrails AI konzentriert sich auf komponierbare Ausgabevalidatoren über seinen Hub — vorgefertigte Prüfungen für Regex-Matching, Längenvalidierung, PII-Erkennung und Toxizitätsbewertung, die LLM-Aufrufe umschließen und Ausgaben automatisch validieren. Metas Llama Guard 3 bietet multimodale Sicherheitsklassifikation über 14 Schadenskategorien, on-premise einsetzbar für datensensible Umgebungen. Für agentenspezifische Sicherheit stellt Metas LlamaFirewall (Mai 2025) ML-basierte Klassifikatoren für Prompt-Injection-Erkennung, Alignment-Prüfung und Code-Sicherheitsanalyse bereit — mit einer Reduktion der Angriffserfolgsrate um über 90 % in Agenten-Benchmarks.

Halluzinationserkennung bleibt die härteste Validierungsherausforderung. Die besten Modelle erreichen mittlerweile Halluzinationsraten unter 1 % bei Zusammenfassungs-Benchmarks — Googles Gemini-2.0-Flash führt mit 0,7 %. Bei allgemeinem Wissen liegen die Halluzinationsraten jedoch durchschnittlich bei rund 9,2 %. RAG reduziert Halluzinationen um 40–71 %, doch Forscher haben mathematisch nachgewiesen, dass eine vollständige Beseitigung von Halluzinationen mit aktuellen LLM-Architekturen unmöglich ist. Produktionssysteme kombinieren daher mehrere Erkennungsmethoden: Chain-of-Verification-Pipelines, die Verifikationsfragen generieren und unabhängig beantworten (Reduktion von Halluzinationen um bis zu 53 %), semantische Entropie, die unterschiedlich formulierte Antworten clustert, um Unsicherheit auf Bedeutungsebene zu messen, sowie Cross-Layer-Attention-Probing, das Halluzinationen in Echtzeit über leichtgewichtige Klassifikatoren auf Modellaktivierungen erkennt.

Wann KI an Menschen übergeben sollte — und wie der Übergang sauber gelingt

Die optimale Human-in-the-Loop-Eskalationsrate für Produktionssysteme liegt bei 10–15 % aller Entscheidungen. Darunter automatisieren Sie wahrscheinlich Aufgaben, die nicht automatisiert werden sollten. Über 20 % entsteht ein Engpass. Ab 60 % braucht Ihr System eine grundlegende Neukalibrierung.

Eskalationsauslöser fallen in drei Kategorien. Konfidenzbasierte Trigger leiten Ausgaben mit niedrigen Werten an Prüfwarteschlangen weiter. Regelbasierte Trigger eskalieren stets bei bestimmten Bedingungen — Finanzbuchungen oberhalb eines Schwellenwerts, Aktionen, die mehrere Nutzer betreffen, erstmalige Aufgabentypen oder Ausgaben, die früheren Entscheidungen für denselben Nutzer widersprechen. Risikomatrix-Trigger bewerten vier Dimensionen gleichzeitig: Irreversibilität der Aktion, Schadensradius eines möglichen Fehlers, Compliance-Exposition und Modellkonfidenz. Erst die Kombination bestimmt, ob menschliche Prüfung erforderlich ist — kein einzelner Faktor allein.

Die Übergabearchitektur ist genauso wichtig wie die Trigger-Logik. In der Produktion dominieren drei Muster:

- Vorab-Genehmigungpausiert die Ausführung vor irreversiblen Aktionen und präsentiert die vorgeschlagene Aktion mit Begründung zur menschlichen Entscheidung.

- Nachträgliches Auditlässt die KI bei reversiblen Entscheidungen sofort handeln, während Menschen stichprobenartig prüfen.

- Konfidenzbasiertes Routing automatisiert die Entscheidung zwischen diesen beiden Modi.

LangGraphs interrupt()-Funktion hat sich als beliebte Implementierungsoption etabliert. Sie pausiert die Graph-Ausführung mitten im Workflow, wartet auf menschliche Eingabe und setzt sauber fort. Für asynchrone Workflows leiten Tools wie HumanLayer Entscheidungen an Slack-Channels, E-Mail oder Dashboards zur nicht-blockierenden Prüfung weiter.

Die Feedback-Schleife von menschlichen Korrekturen zurück in die Modellverbesserung erzeugt kumulierenden Wert. Wenn Reviewer Ausgaben wiederholt aus demselben Grund herabstufen, löst das Prompt-Revisionen oder Vorverarbeitungsänderungen aus. Erfordert eine Aufgabenklasse stets menschliches Eingreifen, signalisiert das: Diese Aufgabe sollte noch nicht automatisiert werden. AWS demonstrierte eine Reduktion des Fachexperten-Aufwands um 80 %, indem RLHF mit RLAIF kombiniert wurde — KI generiert initiale Bewertungen, Menschen verifizieren statt von Grund auf zu erstellen. Cursor verarbeitet täglich 400 Mio. Anfragenfür seine Tab-Funktion und betreibt eine Online-RL-Pipeline, die sich innerhalb von Stunden an Nutzerakzeptanzraten anpasst — mit dem Ergebnis einer 28-prozentigen Steigerung der Code-Akzeptanz.

Domänenspezifische Muster, die in der Praxis funktionieren

Reale HITL-Implementierungen offenbaren aufschlussreiche domänenspezifische Muster. Im Finanzsektor bearbeitet Ramps Policy Agent über 65 % der Ausgabengenehmigungen autonom— doch jede neue Fähigkeit durchläuft zuerst ein Shadow-Mode-Testing. Der Agent prognostiziert Aktionen, während ein LLM-Judge die Vorhersagen mit tatsächlichen menschlichen Entscheidungen abgleicht. Erst nach Erreichen der Genauigkeitsschwellen geht das System live.

Im Gesundheitswesen verbesserten KI-unterstützte Radiologen ihre diagnostische Genauigkeit von Kappa-Werten um 0,6 auf 0,9 — auf dem Niveau von Fachradiologen. Doch hier kommt die unbequeme Erkenntnis: Endoskopiker, die drei Monate lang KI nutzten, sahen ihre Erkennungsraten sinken, nachdem die KI abgeschaltet wurde. Das Deskilling-Risiko ist real — und eine überzeugende Antwort darauf hat bislang niemand.

In der Legal-Tech-Branche prüft KI Verträge 80 % schneller als Menschen — bei 94 % Genauigkeit. Das klingt hervorragend, bis man erfährt, dass nur 68 % der vertragsbezogenen Antworten von GPT-4 von Rechtsexperten als „praktisch verwertbar“ eingestuft wurden. Menschliche Kontrolle bleibt bei folgenschwerer Rechtsarbeit nicht verhandelbar.

Audit-Trails sind keine Option — sie sind gesetzlich vorgeschrieben

Artikel 12 des EU AI Acts verlangt, dass Hochrisiko-KI-Systeme die automatische Protokollierung von Ereignissen über die gesamte Lebensdauer des Systemstechnisch ermöglichen — mit manipulationssicheren Logs, die mindestens sechs Monate aufbewahrt werden müssen. Artikel 26 schreibt vor, dass Betreiber die menschliche Aufsicht kompetenten Personen übertragen und den Systembetrieb überwachen. Strafen reichen bis 35 Mio. € oder 7 % des weltweiten Jahresumsatzes. Zukunftsmusik ist das nicht: Governance-Regeln und Pflichten für Allzweck-KI gelten seit August 2025, die Vorschriften für Hochrisikosysteme treten im August 2026 vollständig in Kraft.

Artikel 22 der DSGVO fügt eine weitere Ebene hinzu: Betroffene haben das Recht, nicht einer ausschließlich auf automatisierter Verarbeitung beruhenden Entscheidung unterworfen zu werden, die rechtliche oder ähnlich erhebliche Wirkung entfaltet. Jedes KI-System, das folgenreiche Entscheidungen über Einzelpersonen trifft — Kreditbewilligungen, Einstellungsentscheidungen, Versicherungstarife — muss Mechanismen für menschliches Eingreifen bereitstellen, die zugrunde liegende Logik erläutern und Betroffenen die Möglichkeit geben, Entscheidungen anzufechten.

Das Observability-Tooling-Ökosystem hat die Reife erreicht, um diesen Anforderungen gerecht zu werden. OpenTelemetrys GenAI Semantic Conventions (v1.37+) haben sich als Industriestandard für LLM-Telemetrie etabliert und definieren gemeinsame Attribute wie gen_ai.request.model, gen_ai.usage.input_tokens und gen_ai.provider.nameanbieterübergreifend. Datadogs LLM Observability unterstützt OTel-GenAI-Konventionen nativ und korreliert LLM-Spans mit traditionellen APM-Traces. Arize AIs Open-Source-Projekt Phoenix verwendet die auf OpenTelemetry basierende OpenInference-Spezifikation. LangSmith erfasst vollständige Ausführungsbäume einschließlich Tool-Auswahl, abgerufener Dokumente und exakter Parameter bei jedem Schritt — mit Annotation-Queues, die Fachexperten das Reviewen und Labeln von Traces ermöglichen.

Produktionsteams protokollieren typischerweise einen umfassenden Metadatensatz pro Inferenzaufruf:

- Vollständiger Ein-/Ausgabeinhalt (oder kryptographische Hashes für sensible Daten)

- Modellname und -version

- Prompt-Template-ID und -Version

- Token-Zähler aufgeschlüsselt nach Eingabe-, Ausgabe-, Cache- und Reasoning-Tokens

- Berechnete Kosten- und Latenzmetriken (Gesamtdauer, Time to First Token, LLM-Verarbeitungszeit)

- Temperature und Sampling-Parameter

- Finish Reason

- Trace- und Span-IDs für Distributed Tracing

- Business-Metadaten wie Nutzer-ID, Umgebung, A/B-Testgruppe und Feature-Flags

Prompt-Versionierung ist zu einer erstklassigen Engineering-Disziplin geworden. Best Practice folgt semantischer Versionierung (major.minor.patch), mit unveränderlichen Versionen — einmal erstellt, wird eine Prompt-Version nie modifiziert. Änderungen erzeugen neue Versionen, die über umgebungsbasierte Promotion bereitgestellt werden (Dev → Staging → Production), wobei jeder Produktions-Trace mit der exakten verwendeten Prompt-Version verknüpft ist. Tools wie LangSmith, Langfuse, Braintrust und Helicone unterstützen dieses Muster nativ. ISO 42001, der weltweit erste zertifizierbare Standard für KI-Managementsysteme, wurde von Microsoft, Google Cloud und AWS übernommen und setzt grundlegende Governance-Erwartungen für Enterprise-KI.

Wie die vier Säulen zu einer einheitlichen Zuverlässigkeitsschicht verschmelzen

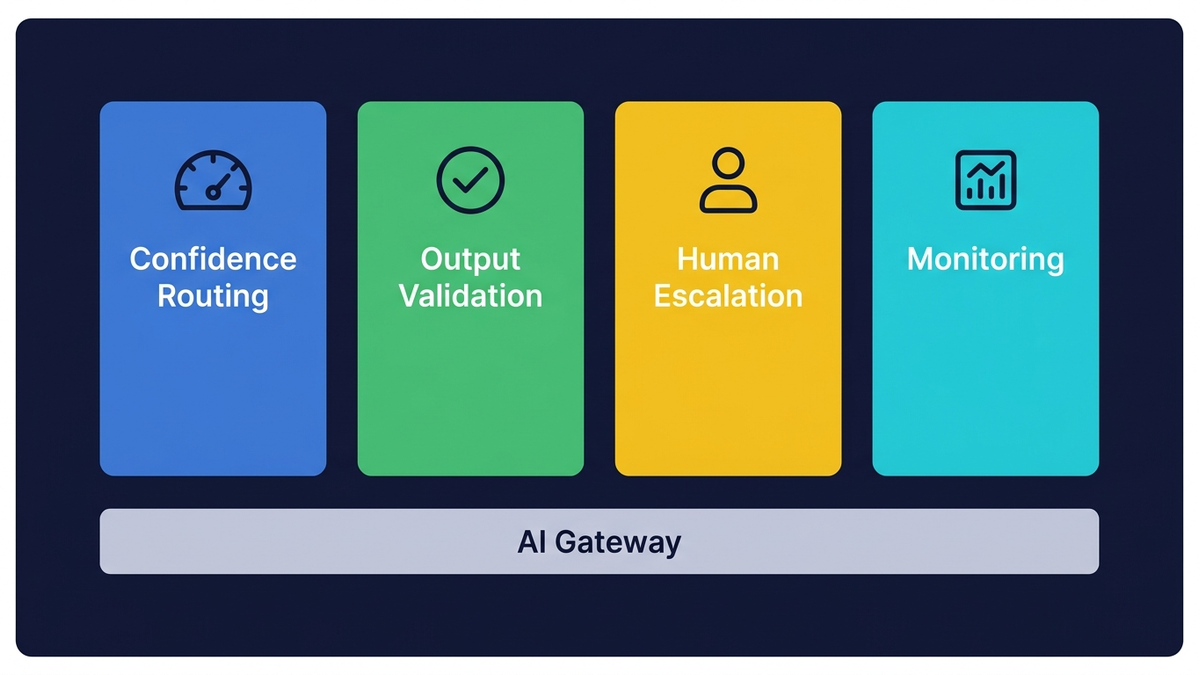

Diese Komponenten arbeiten nicht isoliert. Die Referenzarchitektur, die sich in Produktions-Deployments herauskristallisiert, stapelt sie zu einem geschichteten System:

- Die Applikationsschichtverwaltet Feature-Flags, Canary-Routing und A/B-Tests für Prompt-Änderungen.

- Die KI-Gateway-Schicht — implementiert über Tools wie Portkey (verarbeitet monatlich über 10 Mrd. Anfragen), LiteLLM oder TensorZero — steuert Multi-Provider-Routing, Rate Limiting, Caching, Circuit Breaker und Observability.

- Die Guardrails-Schichterzwingt Eingabe- und Ausgabevalidierung über NeMo Guardrails, Guardrails AI, Llama Guard oder Cloud-native Optionen wie AWS Bedrock Guardrails.

- Die Evaluationsschicht führt CI/CD-Prüfungen über DeepEval und Promptfoo durch, Red-Team-Scans vor dem Deployment und kontinuierliches Produktions-Monitoring.

Für KI-Systeme adaptierte Circuit Breaker ergänzen ein entscheidendes Resilienzmuster. Anders als herkömmliche Circuit Breaker, die bei HTTP-Fehlern auslösen, müssen KI-Circuit-Breaker auch Qualitätsausfälletracken — liefert ein LLM dreimal hintereinander fehlerhaftes JSON oder halluzinierte Daten, löst der Circuit aus, selbst wenn die API-Aufrufe technisch „erfolgreich“ waren. Cox Automotive implementiert harte Grenzen: Konversationen, die 20 Turns überschreiten, oder Kosten, die P95-Schwellenwerte erreichen, lösen automatisch einen geordneten Übergang an menschliche Agenten aus.

Der Multi-Provider-Ausfall vom Dezember 2024, als OpenAI vier Stunden offline war und Claude sowie Gemini gleichzeitig degradierten, bestätigte die Notwendigkeit von Graceful-Degradation-Ketten. Die Standard-Hierarchie fällt über fünf Stufen zurück: Primärmodell zu günstigerem/schnellerem Modell zu gecachten Antworten zu regelbasierten Heuristiken zu menschlicher Eskalation. Das Scheduling-System einer Fluggesellschaft überstand einen Cloud-Ausfall, indem es auf einen heuristischen Optimierer umschaltete (valide in 90 % der Fälle), dann auf eine Regel-Engine für einfache Constraints — die verbleibenden 5 % wurden manuell geprüft. Null Flugstreichungen. Genau diese Art von Resilienz-Engineering trennt Produktionssysteme von Forschungsprojekten.

Canary-Deployments für Prompt-Änderungen folgen derselben Logik wie Code-Canaries, ergänzen aber KI-spezifisches Monitoring. Neue Prompt-Versionen erhalten 1–5 % des Produktionstraffics, während Qualitätsmetriken — nicht nur Fehlerraten — getrackt werden. Prompt-Änderungen können subtile Qualitätsauswirkungen haben, die in System-Health-Metriken unsichtbar bleiben und längere Beobachtungsfenster für statistische Signifikanz erfordern. Erst nach Bestätigung der Qualität wird der Traffic schrittweise auf 100 % hochgefahren.

Lehren von den Teams, die es richtig machen

Aus der Produktionspraxis kristallisiert sich eine klare Erkenntnis: Der Engpass ist die Systemtechnik, nicht die Modellintelligenz.Teams, die zuverlässige LLM-Systeme ausliefern, arbeiten wie Teams, die jede andere kritische Infrastruktur betreiben: diszipliniert bei Fehlermodi, rigoros bei der Evaluation und pragmatisch in der Frage, welche Komponenten kugelsicher sein müssen. Ramp testet jede neue KI-Fähigkeit im Shadow-Modus gegen echte Finanztransaktionen — ohne einen Dollar zu riskieren. Stripe entwickelte ein domänenspezifisches Foundation Model, das die Erkennung von Kreditkartenbetrug von 59 % auf 97 % Genauigkeit steigerte und gleichzeitig 6 Mrd. $ an legitimen Zahlungen zurückgewann. Shopify bedient täglich 30 Mio. Vorhersagenüber mehr als 10.000 Produktkategorien mit einer Händler-Akzeptanzrate von 85 %.

Gartner prognostiziert, dass 40 % der Agentic-AI-Projekte bis 2027 eingestellt werden — aufgrund eskalierender Kosten, unklaren Geschäftswerts oder unzureichender Risikokontrollen. Überleben werden die Teams, die Guardrails von Anfang an als Kerninfrastruktur behandelt haben — und Sicherheitslogik aus Prompts in Code verlagern, wo architektonische Constraints Garantien bieten, die Prompt-Engineering niemals liefern könnte.

Guardrails bremsen nicht — sie machen schnelles Handeln sicher

Zuverlässigkeit produktiver KI konvergiert auf ein klares Architekturmuster: konfidenzbasiertes Routing, mehrschichtige Validierung, strukturierte menschliche Eskalation und umfassende Observability — orchestriert über KI-Gateways als zentrale Steuerungsebene. Der bedeutendste Wandel von 2024–2025 war die systematische Verlagerung von Sicherheitslogik aus Prompts in Infrastruktur.

Organisationen mit ausgereiften Governance-Frameworks erreichen eine dreimal kürzere Time-to-Productionfür neue KI-Features — nicht trotz der Guardrails, sondern wegen ihnen. Allein diese Erkenntnis sollte jedes „Guardrails bremsen uns aus“-Argument in jedem Planungsmeeting für alle Zeiten beenden. Die Systemtechnik ist das Produkt. Die Guardrails sind das Feature.